🎯 MỤC TIÊU

Về kiến thức:

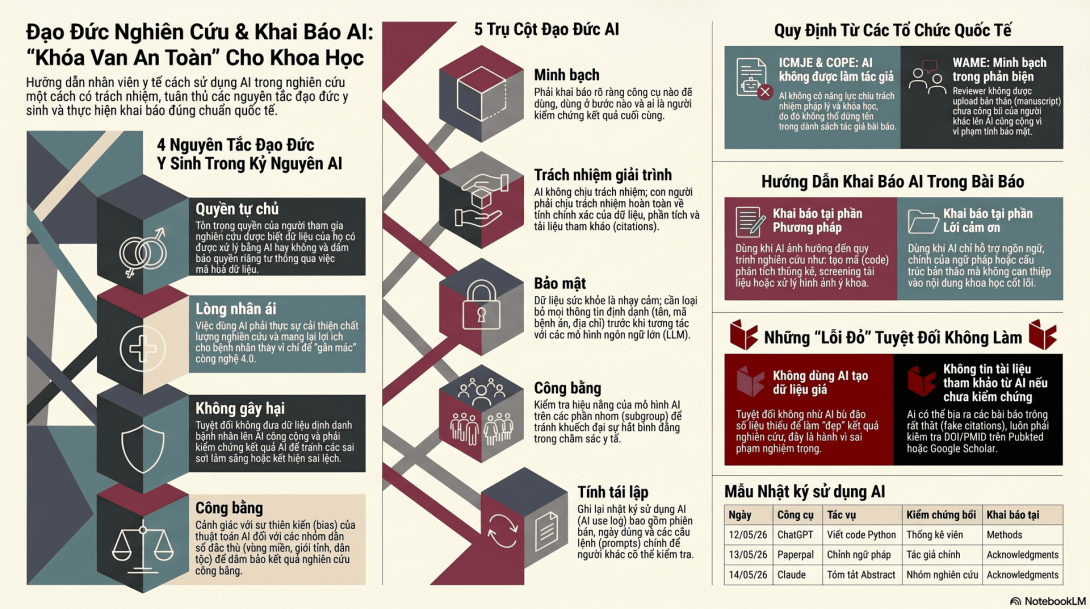

- Trình bày được 4 nguyên tắc đạo đức y sinh học: Autonomy, Beneficence, Non-maleficence, Justice.

- Áp dụng được 4 nguyên tắc này vào nghiên cứu y khoa có sử dụng AI.

- Hiểu các vấn đề đạo đức đặc thù của AI: minh bạch, trách nhiệm giải trình, bảo mật, công bằng, bias, tái lập.

- Nắm được tinh thần chung của các hướng dẫn quốc tế như ICMJE, COPE và WAME về sử dụng AI trong xuất bản khoa học.

- Phân biệt được các mức độ sử dụng AI: hỗ trợ ngôn ngữ, hỗ trợ phân tích, hỗ trợ tổng quan tài liệu, hỗ trợ tạo hình ảnh, hỗ trợ phản biện.

- Nhận diện được các hành vi không được làm: đưa AI làm tác giả, giấu việc dùng AI, đưa dữ liệu bệnh nhân lên AI công cộng, dùng AI tạo dữ liệu giả, tin citation AI chưa kiểm chứng.

Về kỹ năng:

- Viết được AI disclosure statement phù hợp cho Methods, Acknowledgments, Ethics submission và Cover letter.

- Tạo được AI use log ghi lại công cụ, phiên bản, ngày sử dụng, mục đích và cách kiểm chứng.

- Rà soát được consent form để bổ sung nội dung liên quan đến dữ liệu, AI và quyền riêng tư.

- Đánh giá được nguy cơ bias của một mô hình AI trong nghiên cứu y khoa.

- Xây dựng được checklist sử dụng AI có trách nhiệm trước, trong và sau nghiên cứu.

- Phản biện được một tình huống đạo đức liên quan đến AI trong nghiên cứu.

Về thái độ:

- Cam kết minh bạch khi dùng AI trong nghiên cứu.

- Không xem AI là “vùng xám muốn làm gì thì làm”.

- Tôn trọng quyền riêng tư, quyền tự chủ và sự an toàn của người tham gia nghiên cứu.

- Chấp nhận trách nhiệm tác giả 100% đối với mọi nội dung, dữ liệu, phân tích và kết luận trong công trình.

Thông điệp chính:

AI có thể giúp nghiên cứu nhanh hơn, nhưng đạo đức giúp nghiên cứu đứng vững. Không có đạo đức, bài báo có thể trông rất đẹp nhưng nền móng thì như bánh flan để ngoài nắng.

PHẦN 1: VÌ SAO ĐẠO ĐỨC AI TRONG NGHIÊN CỨU LẠI QUAN TRỌNG?

1.1. Nghiên cứu y khoa không chỉ là dữ liệu

Trong nghiên cứu y khoa, dữ liệu thường đến từ:

- Bệnh nhân.

- Hồ sơ bệnh án.

- Xét nghiệm.

- Hình ảnh y khoa.

- Phỏng vấn.

- Nhân viên y tế.

- Quy trình chăm sóc.

- Dữ liệu nhạy cảm về sức khỏe, hành vi, tâm lý, tài chính, địa lý.

Khi dùng AI, các dữ liệu này có thể bị:

- Lộ ra ngoài hệ thống bệnh viện.

- Được lưu trên máy chủ bên thứ ba.

- Được dùng để huấn luyện mô hình nếu cấu hình không phù hợp.

- Bị diễn giải sai.

- Bị trích xuất lại ngoài ý muốn.

- Gây hại nếu kết quả AI sai mà người dùng tin quá mức.

Vì vậy, dùng AI trong nghiên cứu không chỉ là câu hỏi “có tiện không?”, mà là câu hỏi:

Có an toàn, minh bạch, công bằng, có thể kiểm chứng và có người chịu trách nhiệm không?

1.2. AI làm tăng tốc cả điều tốt lẫn điều xấu

AI có thể giúp:

- Viết nhanh hơn.

- Tóm tắt nhanh hơn.

- Phân tích nhanh hơn.

- Tạo bảng, code, hình nhanh hơn.

- Dịch và chỉnh tiếng Anh nhanh hơn.

Nhưng AI cũng có thể làm nhanh hơn các lỗi:

- Tạo tài liệu tham khảo giả.

- Tạo lập luận nghe hợp lý nhưng sai.

- Che giấu thiếu hiểu biết thống kê.

- Tạo kết quả không kiểm chứng.

- Khuếch đại bias.

- Làm người nghiên cứu lười kiểm tra.

- Vi phạm bảo mật chỉ bằng một cú copy-paste.

Bài 2 đã nhấn mạnh các rủi ro lớn của AI trong nghiên cứu: hallucination, bias, bảo mật, mất tư duy phản biện và tài liệu giả.

PHẦN 2: 4 NGUYÊN TẮC ĐẠO ĐỨC Y SINH HỌC

Khung chương trình gốc của Bài 18 dựa trên 4 nguyên tắc đạo đức y sinh học của Beauchamp & Childress: Autonomy, Beneficence, Non-maleficence, Justice.

2.1. Autonomy — Tôn trọng quyền tự chủ

Ý nghĩa

Autonomy là tôn trọng quyền của người tham gia nghiên cứu được:

- Biết nghiên cứu nhằm mục đích gì.

- Biết họ sẽ cung cấp dữ liệu gì.

- Biết dữ liệu được dùng như thế nào.

- Biết có sử dụng AI hay không nếu điều đó ảnh hưởng đến dữ liệu/quyết định nghiên cứu.

- Tự nguyện tham gia.

- Từ chối hoặc rút lui mà không bị ảnh hưởng đến điều trị/công việc.

- Được bảo mật thông tin cá nhân.

Áp dụng khi dùng AI

Nếu nghiên cứu dùng AI để:

- Phân tích dữ liệu bệnh nhân.

- Phân loại nguy cơ.

- Tạo quyết định hỗ trợ lâm sàng.

- Xử lý hình ảnh y khoa.

- Tóm tắt hồ sơ bệnh án.

- Phân tích phỏng vấn định tính.

- Tạo transcript hoặc mã hóa nội dung nhạy cảm.

Thì cần cân nhắc liệu consent form có nói rõ không.

Ví dụ

Không nên viết consent form quá chung:

Dữ liệu của anh/chị sẽ được dùng cho nghiên cứu.

Tốt hơn:

Dữ liệu nghiên cứu có thể được xử lý bằng phần mềm thống kê và/hoặc công cụ hỗ trợ phân tích dữ liệu. Mọi dữ liệu sẽ được mã hóa trước khi phân tích. Không có thông tin định danh cá nhân như họ tên, số hồ sơ bệnh án, số điện thoại hoặc địa chỉ được đưa vào các công cụ AI công cộng.

Câu hỏi tự kiểm tra

- Người tham gia có biết dữ liệu của họ được dùng thế nào không?

- Có cần nói rõ về AI trong phiếu đồng thuận không?

- Người tham gia có quyền rút lui không?

- Dữ liệu đã được mã hóa chưa?

- Có thông tin nào khiến bệnh nhân có thể bị nhận diện không?

2.2. Beneficence — Làm lợi

Ý nghĩa

Beneficence yêu cầu nghiên cứu phải hướng đến lợi ích:

- Cho bệnh nhân.

- Cho cộng đồng.

- Cho chất lượng chăm sóc.

- Cho tri thức khoa học.

- Cho hệ thống y tế.

Áp dụng khi dùng AI

Dùng AI phải giúp nghiên cứu tốt hơn, không chỉ làm nghiên cứu “trông hiện đại hơn”.

AI có thể làm lợi nếu:

- Giúp phát hiện lỗi dữ liệu.

- Giúp phân tích nhanh nhưng vẫn kiểm chứng.

- Giúp người không giỏi tiếng Anh trình bày rõ hơn.

- Giúp tìm bằng chứng khoa học nhanh hơn.

- Giúp phát hiện bias hoặc thiếu sót trong protocol.

- Giúp tạo tài liệu giáo dục bệnh nhân dễ hiểu hơn.

AI không làm lợi nếu:

- Chỉ dùng để “gắn mác AI”.

- Viết hộ toàn bộ đề cương mà người nghiên cứu không hiểu.

- Tạo citation giả.

- Tạo phân tích mà nhóm nghiên cứu không kiểm tra.

- Gợi ý kết luận vượt quá dữ liệu.

Câu hỏi tự kiểm tra

Việc dùng AI ở bước này có thật sự cải thiện chất lượng nghiên cứu không, hay chỉ làm tôi thấy mình rất “4.0”?

2.3. Non-maleficence — Không gây hại

Ý nghĩa

Non-maleficence là nguyên tắc “trước hết, không gây hại”.

Trong nghiên cứu có AI, nguy cơ gây hại có thể đến từ:

- Lộ dữ liệu bệnh nhân.

- Mô hình dự đoán sai.

- AI tạo khuyến nghị sai.

- Bias làm hại một nhóm bệnh nhân.

- Kết quả sai được công bố và ảnh hưởng thực hành.

- Dữ liệu bị xử lý ngoài sự đồng ý.

- Người nghiên cứu tin AI hơn chuyên môn.

Ví dụ nguy cơ

Một nhóm nghiên cứu dùng AI công cộng để phân tích file Excel có:

- Họ tên bệnh nhân.

- Mã bệnh án.

- Ngày sinh.

- Địa chỉ.

- Chẩn đoán HIV.

- Kết quả xét nghiệm.

Dù mục tiêu nghiên cứu tốt, hành động này có thể gây hại nghiêm trọng vì vi phạm bảo mật.

Cách giảm hại

- Không đưa dữ liệu định danh lên AI công cộng.

- Dùng dữ liệu giả lập cho thực hành.

- Ẩn danh hoặc mã hóa dữ liệu.

- Kiểm tra chính sách bảo mật của công cụ AI.

- Dùng hệ thống AI nội bộ nếu bệnh viện có.

- Ghi lại prompt/output để audit.

- Kiểm tra lại kết quả bằng phương pháp truyền thống.

- Không dùng AI làm quyết định cuối cùng về bệnh nhân hoặc đạo đức nghiên cứu.

2.4. Justice — Công bằng

Ý nghĩa

Justice yêu cầu nghiên cứu phải công bằng:

- Trong tuyển chọn đối tượng.

- Trong phân bổ lợi ích và rủi ro.

- Trong sử dụng dữ liệu.

- Trong cách mô hình AI hoạt động với các nhóm khác nhau.

AI có thể gây bất công như thế nào?

AI có thể hoạt động kém hơn trên:

- Người dân nông thôn.

- Người dân tộc thiểu số.

- Người cao tuổi.

- Người ít dữ liệu trong hồ sơ.

- Phụ nữ nếu dữ liệu huấn luyện chủ yếu là nam.

- Người Việt nếu mô hình huấn luyện chủ yếu trên người Âu/Mỹ.

- Bệnh viện tuyến huyện nếu dữ liệu huấn luyện từ bệnh viện trung ương.

Ví dụ

Một mô hình dự đoán tái nhập viện được huấn luyện từ 80% bệnh nhân ở bệnh viện thành thị và chỉ 20% từ bệnh viện nông thôn. Khi áp dụng tại bệnh viện huyện, mô hình có thể đánh giá sai nguy cơ của bệnh nhân nông thôn.

Câu hỏi tự kiểm tra

- Dữ liệu huấn luyện có đại diện cho nhóm bệnh nhân của tôi không?

- Mô hình có hoạt động khác nhau theo giới, tuổi, vùng miền không?

- Có nhóm nào bị bỏ sót hoặc bị cảnh báo quá mức không?

- Nếu mô hình sai, nhóm nào chịu hại nhiều nhất?

PHẦN 3: 5 NGUYÊN TẮC AI ETHICS TRONG NGHIÊN CỨU

Khung Bài 18 nêu 5 nguyên tắc AI ethics trong nghiên cứu: Transparency, Accountability, Privacy & Security, Fairness, Reproducibility.

3.1. Transparency — Minh bạch

Ý nghĩa

Người đọc, hội đồng đạo đức, editor và reviewer cần biết:

- Có dùng AI không?

- Dùng công cụ nào?

- Dùng ở bước nào?

- Dùng để làm gì?

- Ai kiểm tra kết quả?

- Có ảnh hưởng đến dữ liệu/phân tích/kết luận không?

Không minh bạch là gì?

- Dùng AI viết phần lớn manuscript nhưng không khai báo.

- Dùng AI tạo code phân tích nhưng không kiểm chứng.

- Dùng AI tóm tắt tài liệu rồi trích dẫn như đã đọc kỹ.

- Dùng AI tạo hình ảnh hoặc bảng nhưng không nói rõ.

- Dùng AI trong peer review khi tạp chí không cho phép.

Minh bạch không có nghĩa là tự làm mình yếu đi

Khai báo AI đúng cách không phải là “tự thú”. Nó cho thấy nhóm nghiên cứu có trách nhiệm, biết kiểm soát công cụ và tôn trọng chuẩn mực xuất bản.

3.2. Accountability — Trách nhiệm giải trình

Ý nghĩa

AI không chịu trách nhiệm. Con người chịu trách nhiệm.

ICMJE yêu cầu tác giả khai báo việc dùng công nghệ AI hỗ trợ trong sản xuất bản thảo; COPE cũng khẳng định công cụ AI không thể được liệt kê là tác giả vì không thể chịu trách nhiệm cho công trình. (ICMJE)

Tác giả phải chịu trách nhiệm về:

- Tính chính xác của dữ liệu.

- Tính chính xác của phân tích.

- Tính thật của tài liệu tham khảo.

- Tính trung thực của hình ảnh/bảng biểu.

- Tính hợp lý của kết luận.

- Việc bảo mật dữ liệu.

- Việc khai báo AI.

- Việc tuân thủ chính sách tạp chí/bệnh viện.

Câu hỏi tự kiểm tra

Nếu editor hỏi: “AI đã hỗ trợ ở đâu, và ai kiểm tra nội dung đó?”, tôi có trả lời rõ được không?

Nếu câu trả lời là “không nhớ lắm”, cần lập AI use log ngay. Con mèo AI đã chạy qua bàn phím thì phải có dấu chân.

3.3. Privacy & Security — Quyền riêng tư và bảo mật

Ý nghĩa

Dữ liệu sức khỏe là dữ liệu nhạy cảm. Không được đưa dữ liệu định danh lên công cụ AI công cộng nếu chưa được phép và chưa đánh giá bảo mật.

Thông tin định danh cần tránh

- Họ tên.

- Mã hồ sơ bệnh án.

- Số căn cước.

- Ngày sinh đầy đủ.

- Số điện thoại.

- Địa chỉ.

- Ảnh mặt.

- Hình ảnh có metadata.

- Ngày nhập viện quá cụ thể nếu ca hiếm.

- Bệnh hiếm kết hợp thông tin địa lý có thể nhận diện.

- Nội dung phỏng vấn có tên người/địa điểm cụ thể.

Cách xử lý an toàn hơn

- Dùng mã nghiên cứu thay vì tên.

- Loại bỏ biến định danh.

- Gom nhóm tuổi thay vì ngày sinh.

- Xóa metadata ảnh.

- Dùng dữ liệu giả lập khi học.

- Dùng công cụ nội bộ được bệnh viện phê duyệt.

- Không copy nguyên văn bệnh án vào chatbot công cộng.

- Hỏi bộ phận pháp chế/IT/hội đồng đạo đức nếu không chắc.

3.4. Fairness — Công bằng và không bias

Ý nghĩa

Mô hình AI hoặc quy trình AI không được làm bất lợi một cách không công bằng cho một nhóm người.

Cần kiểm tra

- Tỷ lệ dữ liệu theo nhóm tuổi/giới/vùng miền.

- Hiệu năng mô hình theo subgroup.

- Missing data có tập trung ở nhóm nào không?

- AI có gợi ý câu hỏi, phân tích hoặc diễn giải thiên lệch không?

- Công cụ AI có phù hợp tiếng Việt/bối cảnh Việt Nam không?

Ví dụ

Nếu AI tóm tắt nghiên cứu quốc tế và gợi ý áp dụng ngay tại Việt Nam, cần hỏi:

- Dân số nghiên cứu có giống bệnh nhân Việt Nam không?

- Cơ sở vật chất có giống không?

- Chi phí có phù hợp không?

- Văn hóa chăm sóc có khác không?

- Hệ thống y tế có đủ nguồn lực không?

3.5. Reproducibility — Tái lập được

Ý nghĩa

Người khác phải hiểu được AI đã được dùng thế nào để có thể đánh giá hoặc lặp lại quy trình.

Cần ghi lại

- Tên công cụ.

- Phiên bản nếu có.

- Ngày sử dụng.

- Prompt chính.

- Output chính.

- Ai kiểm tra output.

- Output được chỉnh sửa thế nào.

- Có dữ liệu nào đưa vào công cụ không.

- Có dùng dữ liệu giả lập hay dữ liệu thật không.

- Có lưu code/log không.

AI use log mẫu

| Ngày | Công cụ | Phiên bản | Mục đích | Dữ liệu nhập vào | Prompt chính | Người kiểm tra | Ghi chú |

|---|---|---|---|---|---|---|---|

| 12/05/2026 | ChatGPT | GPT-5.5 | Chỉnh tiếng Anh Abstract | Không có dữ liệu định danh | “Improve clarity…” | Tác giả chính | Đã chỉnh lại thủ công |

| 13/05/2026 | Claude | Version… | Tóm tắt 5 abstract đã xác minh | Abstract công khai | “Summarize…” | 2 tác giả | Không thêm citation mới |

| 14/05/2026 | ChatGPT | GPT-5.5 | Viết code Python | Dataset đã ẩn danh | “Generate code…” | Thống kê viên | Kết quả kiểm tra bằng SPSS |

PHẦN 4: HƯỚNG DẪN ICMJE, COPE, WAME — HIỂU THẾ NÀO CHO ĐÚNG?

Khung chương trình gốc yêu cầu học viên nắm các hướng dẫn lớn gồm ICMJE, COPE và WAME, đặc biệt các điểm: AI không thể là tác giả, cần khai báo việc sử dụng AI, tác giả chịu trách nhiệm nội dung và AI không thể ký các tuyên bố trách nhiệm/xung đột lợi ích.

4.1. ICMJE — International Committee of Medical Journal Editors

Điểm cốt lõi

ICMJE nêu rằng tạp chí nên yêu cầu tác giả khai báo khi dùng công nghệ AI hỗ trợ như LLM, chatbot hoặc công cụ tạo ảnh trong quá trình tạo ra công trình gửi đăng. (ICMJE)

Ý nghĩa thực hành

Nếu dùng AI để:

- Viết nháp.

- Chỉnh ngôn ngữ.

- Tạo code phân tích.

- Tóm tắt tài liệu.

- Tạo bảng.

- Tạo hình ảnh.

- Hỗ trợ diễn giải.

- Hỗ trợ trả lời reviewer.

Thì cần kiểm tra chính sách tạp chí và khai báo đúng vị trí.

AI có được làm tác giả không?

Không. AI không có năng lực chịu trách nhiệm, không thể phê duyệt bản thảo cuối cùng, không thể ký conflict of interest, không thể chịu trách nhiệm pháp lý hoặc khoa học.

4.2. COPE — Committee on Publication Ethics

COPE nêu rõ AI tools như ChatGPT hoặc các LLM không thể được liệt kê là tác giả vì không thể chịu trách nhiệm cho công trình đã công bố. (Publication Ethics)

Ý nghĩa thực hành

Không được ghi:

Authors: Nguyen A, Tran B, ChatGPT

Không được ghi:

ChatGPT contributed to conceptualization and writing as a co-author.

Có thể ghi trong Acknowledgments hoặc Methods tùy mức độ sử dụng, ví dụ:

ChatGPT was used to assist with English language editing. The authors reviewed and edited all outputs and take full responsibility for the final content.

4.3. WAME — World Association of Medical Editors

WAME đưa ra khuyến nghị giúp editors, authors và reviewers xử lý việc sử dụng chatbot/generative AI trong scholarly manuscripts; WAME nhấn mạnh cần minh bạch khi dùng chatbot và cách quy attribution trong công bố học thuật. (WAME)

Ý nghĩa thực hành

WAME hữu ích cho 3 nhóm:

- Authors: khai báo AI và chịu trách nhiệm.

- Editors: xây dựng chính sách tạp chí.

- Reviewers: cẩn trọng với bảo mật khi dùng AI hỗ trợ phản biện.

Điểm nhạy cảm: Reviewer dùng AI

Nếu bạn là reviewer, manuscript đang phản biện là tài liệu mật. Không được upload bản thảo của người khác lên AI công cộng nếu chưa được tạp chí cho phép. Đây là điểm rất quan trọng, vì nhiều người nghĩ “mình chỉ nhờ AI tóm tắt chút thôi” — nhưng một chút này có thể làm rò rỉ manuscript chưa công bố.

PHẦN 5: KHI NÀO KHAI BÁO AI Ở METHODS, ACKNOWLEDGMENTS HAY COVER LETTER?

5.1. Khai báo trong Methods

Dùng khi AI ảnh hưởng đến quy trình nghiên cứu, dữ liệu hoặc phân tích.

Ví dụ:

- AI hỗ trợ screening trong systematic review.

- AI hỗ trợ trích xuất dữ liệu.

- AI tạo code phân tích thống kê.

- AI hỗ trợ phân tích định tính.

- AI là một phần của intervention.

- AI là công cụ được đánh giá trong nghiên cứu.

- AI được dùng để xử lý hình ảnh y khoa.

- AI được dùng để xây dựng prediction model.

Mẫu Methods — AI hỗ trợ phân tích dữ liệu

[Tool name, version] was used to generate Python code for statistical analysis. The following prompts were used: [brief description or appendix]. All code and outputs were reviewed by the study team and verified against [SPSS/R/manual calculation/biostatistician review]. No identifiable patient data were entered into the AI tool.

Bản tiếng Việt:

Công cụ [tên công cụ, phiên bản] được sử dụng để hỗ trợ tạo mã Python cho phân tích thống kê. Các prompt chính được lưu trong phụ lục nghiên cứu. Toàn bộ mã và kết quả đầu ra được nhóm nghiên cứu kiểm tra và đối chiếu với [SPSS/R/tính toán thủ công/ý kiến thống kê viên]. Không có dữ liệu định danh bệnh nhân được nhập vào công cụ AI.

5.2. Khai báo trong Acknowledgments

Dùng khi AI chỉ hỗ trợ ngôn ngữ, cấu trúc hoặc readability, không ảnh hưởng đến dữ liệu/phân tích/kết luận.

Mẫu Acknowledgments — AI hỗ trợ viết

Khung chương trình gốc có mẫu: AI hỗ trợ readability/grammar, tác giả review/edit output và chịu trách nhiệm nội dung.

During the preparation of this manuscript, we used [Tool name, version] to improve readability and grammar. The authors reviewed and edited the output and take full responsibility for the content of this publication.

Bản tiếng Việt:

Trong quá trình chuẩn bị bản thảo, nhóm tác giả đã sử dụng [tên công cụ, phiên bản] để hỗ trợ cải thiện độ rõ ràng và ngữ pháp. Nhóm tác giả đã kiểm tra, chỉnh sửa toàn bộ nội dung đầu ra và chịu trách nhiệm hoàn toàn về nội dung của công trình.

5.3. Khai báo trong Cover letter hoặc submission system

Nhiều tạp chí hỏi trực tiếp:

- Did you use AI tools?

- If yes, describe how.

- Did AI generate images?

- Did AI assist in data analysis?

- Did authors verify all AI outputs?

Mẫu câu trả lời ngắn

Yes. Generative AI was used only for language editing and improving clarity. No AI tool was used to generate data, create analyses, or make scientific interpretations. All AI-assisted text was reviewed and edited by the authors.

5.4. Khai báo trong Ethics submission

Nếu nghiên cứu dùng AI liên quan đến dữ liệu hoặc can thiệp, nên nêu trong hồ sơ đạo đức:

- Công cụ AI nào.

- Mục đích dùng.

- Loại dữ liệu đưa vào.

- Có dữ liệu định danh không.

- Dữ liệu lưu ở đâu.

- Ai có quyền truy cập.

- Rủi ro và biện pháp giảm thiểu.

- Người tham gia có được thông báo không.

- Có khả năng bias không.

- Có con người giám sát không.

Mẫu Ethics submission

Nghiên cứu có sử dụng công cụ AI để hỗ trợ [mục đích]. Dữ liệu đưa vào công cụ đã được mã hóa và loại bỏ thông tin định danh. Công cụ AI không được sử dụng để đưa ra quyết định lâm sàng trực tiếp. Tất cả kết quả đầu ra từ AI sẽ được nhóm nghiên cứu kiểm tra độc lập trước khi sử dụng. Nhóm nghiên cứu sẽ lưu lại nhật ký sử dụng AI gồm tên công cụ, phiên bản, ngày sử dụng, prompt chính và cách kiểm chứng kết quả.

PHẦN 6: CÁC MỨC ĐỘ SỬ DỤNG AI VÀ YÊU CẦU KHAI BÁO

| Mức độ dùng AI | Ví dụ | Khai báo ở đâu? | Mức rủi ro |

|---|---|---|---|

| Chỉnh ngữ pháp | Paperpal/Grammarly/ChatGPT sửa câu tiếng Anh | Acknowledgments hoặc theo chính sách tạp chí | Thấp |

| Cấu trúc bản thảo | AI gợi ý outline IMRAD | Acknowledgments nếu đáng kể | Thấp–trung bình |

| Tóm tắt tài liệu | AI tóm tắt abstract đã xác minh | Methods nếu là systematic review; có thể Acknowledgments nếu hỗ trợ viết | Trung bình |

| Tạo code phân tích | AI viết Python/R/SPSS syntax | Methods | Trung bình–cao |

| Phân tích dữ liệu | AI chạy/tạo output phân tích | Methods, cần audit trail | Cao |

| Xử lý dữ liệu bệnh nhân | AI phân tích hồ sơ/hình ảnh | Methods + Ethics + privacy plan | Cao |

| AI là intervention | Dùng chatbot tư vấn bệnh nhân | Protocol/Methods/Ethics/Trial registration | Rất cao |

| AI tạo hình ảnh khoa học | Hình minh họa/graphical abstract | Theo chính sách tạp chí | Trung bình–cao |

| AI trong peer review | Reviewer dùng AI hỗ trợ nhận xét | Theo chính sách journal/editor | Rất nhạy cảm |

PHẦN 7: NHỮNG VIỆC TUYỆT ĐỐI KHÔNG LÀM

Khung chương trình gốc liệt kê các red flags: không đưa AI làm tác giả, không upload dữ liệu bệnh nhân lên AI công cộng, không tin citation AI chưa kiểm chứng, không giấu AI use, không để AI ra quyết định đạo đức, không dùng AI trong peer review khi chưa được phép, không tạo dữ liệu giả bằng AI.

7.1. Không liệt kê AI là tác giả

Sai:

Nguyen A, Tran B, ChatGPT.

Đúng:

AI được khai báo trong Acknowledgments hoặc Methods nếu có sử dụng đáng kể.

7.2. Không đưa dữ liệu bệnh nhân lên AI công cộng

Sai:

Tôi dán file Excel có tên, mã bệnh án, ngày sinh, chẩn đoán vào ChatGPT để phân tích nhanh.

Đúng:

Tôi dùng dataset đã mã hóa, loại bỏ định danh, được hội đồng đạo đức/đơn vị phê duyệt, và chạy phân tích trong môi trường an toàn.

7.3. Không tin citation AI chưa kiểm chứng

Sai:

AI cho 20 tài liệu, tôi copy vào Zotero.

Đúng:

Tôi dùng AI gợi ý từ khóa, sau đó tự tìm bài thật trên PubMed/Google Scholar, kiểm tra DOI/PMID và lưu từ nguồn gốc.

7.4. Không để AI quyết định đạo đức

AI có thể gợi ý checklist, nhưng không thể quyết định:

- Có cần informed consent không.

- Có được miễn consent không.

- Có được dùng dữ liệu bệnh nhân không.

- Có được triển khai mô hình AI vào bệnh viện không.

- Có chấp nhận rủi ro cho người tham gia không.

Các quyết định này thuộc về nhóm nghiên cứu, hội đồng đạo đức, cơ sở y tế và quy định pháp lý.

7.5. Không dùng AI để tạo dữ liệu giả

Sai nghiêm trọng:

Dataset thiếu 20 bệnh nhân, tôi nhờ AI tạo thêm cho đủ cỡ mẫu.

Đây là fabrication, một dạng sai phạm nghiên cứu nghiêm trọng.

Dữ liệu mô phỏng chỉ được dùng cho:

- Học tập.

- Thực hành code.

- Minh họa phương pháp.

Không được đưa dữ liệu mô phỏng vào kết quả nghiên cứu thật nếu không khai báo rõ.

PHẦN 8: AI USE LOG — NHẬT KÝ SỬ DỤNG AI

8.1. Vì sao cần AI use log?

AI use log giúp:

- Minh bạch.

- Tái lập được.

- Trả lời editor/reviewer.

- Chuẩn bị disclosure.

- Kiểm tra rủi ro bảo mật.

- Phân biệt AI hỗ trợ gì và con người quyết định gì.

- Bảo vệ nhóm nghiên cứu nếu có câu hỏi sau này.

8.2. Mẫu AI use log

| Ngày | Công cụ | Phiên bản | Tác vụ | Dữ liệu nhập | Output dùng thế nào | Kiểm chứng | Khai báo ở đâu |

|---|---|---|---|---|---|---|---|

| 10/05/2026 | ChatGPT | GPT-5.5 | Gợi ý outline Discussion | Không có dữ liệu định danh | Dùng làm nháp | Tác giả chỉnh toàn bộ | Acknowledgments |

| 11/05/2026 | Elicit | Version… | Tìm bài liên quan | Câu hỏi nghiên cứu | Danh sách bài | Kiểm tra PubMed | Methods nếu systematic review |

| 12/05/2026 | ChatGPT | GPT-5.5 | Tạo code R | Dataset đã ẩn danh | Dùng code sau khi kiểm tra | So với SPSS | Methods |

| 13/05/2026 | Paperpal | Version… | Chỉnh ngữ pháp | Manuscript không có dữ liệu định danh | Cải thiện câu | Tác giả duyệt | Acknowledgments |

PHẦN 9: CONSENT FORM KHI NGHIÊN CỨU CÓ AI

9.1. Consent form cần có gì?

Một consent form cơ bản cần giải thích:

- Tên nghiên cứu.

- Mục tiêu.

- Vì sao người tham gia được mời.

- Quy trình tham gia.

- Thời gian tham gia.

- Dữ liệu sẽ thu thập.

- Rủi ro.

- Lợi ích.

- Tự nguyện tham gia.

- Quyền rút lui.

- Bảo mật dữ liệu.

- Ai được truy cập dữ liệu.

- Liên hệ khi có thắc mắc.

- Bồi thường/hỗ trợ nếu có.

Bài thực hành của khung chương trình yêu cầu học viên rà soát consent form tiếng Việt theo các tiêu chí: mục đích nghiên cứu, tự nguyện tham gia, quyền rút lui, quyền riêng tư dữ liệu, rủi ro/lợi ích và thông tin liên hệ.

9.2. Khi nào consent form cần nói về AI?

Nên cân nhắc nêu AI nếu:

- AI xử lý dữ liệu người tham gia.

- AI là một phần của can thiệp.

- AI hỗ trợ ra quyết định hoặc phân loại nguy cơ.

- Dữ liệu được gửi đến nền tảng bên thứ ba.

- AI tạo transcript hoặc phân tích phỏng vấn.

- AI xử lý hình ảnh y khoa.

- Kết quả AI có thể ảnh hưởng cách chăm sóc/nghiên cứu.

9.3. Mẫu đoạn consent form về AI

Trong nghiên cứu này, một số dữ liệu đã được mã hóa có thể được xử lý bằng phần mềm hỗ trợ phân tích dữ liệu, bao gồm công cụ trí tuệ nhân tạo nếu được nhóm nghiên cứu và hội đồng đạo đức phê duyệt. Các thông tin định danh trực tiếp như họ tên, số điện thoại, địa chỉ và mã hồ sơ bệnh án sẽ không được đưa vào các công cụ AI công cộng. Kết quả từ công cụ AI chỉ được sử dụng để hỗ trợ phân tích nghiên cứu và sẽ được nhóm nghiên cứu kiểm tra trước khi sử dụng.

9.4. Mẫu đoạn quyền rút lui

Việc tham gia nghiên cứu là hoàn toàn tự nguyện. Anh/chị có quyền từ chối tham gia hoặc rút khỏi nghiên cứu bất kỳ lúc nào mà không ảnh hưởng đến việc điều trị, chăm sóc hoặc quyền lợi hợp pháp của anh/chị tại bệnh viện.

PHẦN 10: BIAS DETECTION TRONG NGHIÊN CỨU CÓ AI

10.1. Bias có thể xuất hiện ở đâu?

Bias có thể xuất hiện ở:

- Câu hỏi nghiên cứu.

- Dữ liệu huấn luyện.

- Cách chọn mẫu.

- Missing data.

- Cách định nghĩa outcome.

- Cách mô hình học.

- Cách đánh giá mô hình.

- Cách triển khai.

- Cách con người phản ứng với output AI.

10.2. Case mẫu từ khung chương trình

Một thuật toán AI dự đoán tái nhập viện bệnh viện được huấn luyện với dữ liệu 80% từ bệnh viện đô thị và 20% từ bệnh viện nông thôn. Học viên cần phân tích bias có thể có, cách phát hiện, cách xử lý và cách báo cáo trong manuscript.

10.3. Câu hỏi phân tích bias

| Câu hỏi | Ý nghĩa |

|---|---|

| Dữ liệu huấn luyện đến từ đâu? | Có đại diện không? |

| Nhóm nào ít được đại diện? | Nguy cơ mô hình kém ở nhóm đó |

| Outcome có được đo giống nhau ở mọi nhóm không? | Tránh measurement bias |

| Missing data có khác giữa nhóm không? | Tránh bias do thiếu dữ liệu |

| AUROC/sensitivity/specificity có khác theo subgroup không? | Kiểm tra fairness |

| Calibration có khác theo nhóm không? | Kiểm tra xác suất dự đoán |

| Nếu false negative xảy ra, ai chịu hại? | Đánh giá nguy cơ lâm sàng |

| Nếu false positive xảy ra, ai chịu gánh nặng? | Đánh giá sử dụng nguồn lực |

PHẦN 11: THỰC HÀNH TRÊN LỚP

Tổng thời lượng thực hành: 70 phút

Thực hành 1: Case Analysis — Ethical Violation hay Acceptable Use?

Thời lượng: 20 phút

Case 1: Ethical Violation?

Tình huống từ khung chương trình:

Một nghiên cứu viên upload dữ liệu bệnh nhân đã “de-identified” lên ChatGPT để phân tích. Kết quả trông tốt, bài được xuất bản nhưng không khai báo việc dùng AI.

Câu hỏi thảo luận

- Có những vấn đề đạo đức nào?

- “De-identified” đã đủ an toàn chưa?

- Có vi phạm guideline nào không?

- Có cần disclosure không?

- Lẽ ra nên làm gì?

- Hậu quả có thể là gì?

Gợi ý trả lời

Các vấn đề:

- Chưa chắc dữ liệu đã được ẩn danh đúng chuẩn.

- Không rõ công cụ AI có lưu dữ liệu không.

- Không có audit trail.

- Không khai báo AI use.

- Không rõ output được kiểm chứng thế nào.

- Có thể vi phạm chính sách bệnh viện/tạp chí.

- Có thể vi phạm quyền riêng tư nếu dữ liệu còn khả năng nhận diện.

Cách đúng hơn:

- Kiểm tra chính sách bệnh viện.

- Dùng công cụ được phê duyệt.

- Loại bỏ định danh và đánh giá re-identification risk.

- Ghi AI use log.

- Kiểm chứng kết quả.

- Khai báo trong Methods nếu AI hỗ trợ phân tích.

Case 2: Appropriate Use?

Tình huống từ khung chương trình:

Nghiên cứu viên dùng Claude để cải thiện ngữ pháp tiếng Anh trong manuscript, kiểm tra toàn bộ thay đổi và khai báo trong Acknowledgments.

Câu hỏi thảo luận

- Việc này có chấp nhận được không?

- Khai báo như vậy đã đủ chưa?

- Tác giả có còn chịu trách nhiệm không?

- Có cần đưa vào Methods không?

Gợi ý trả lời

Đây thường là cách dùng hợp lý nếu:

- Không đưa dữ liệu nhạy cảm.

- AI chỉ chỉnh ngôn ngữ.

- Tác giả đọc và duyệt toàn bộ.

- Có disclosure phù hợp theo chính sách tạp chí.

- Không để AI thêm nội dung khoa học mới.

Nếu chỉ chỉnh ngôn ngữ, Acknowledgments hoặc AI disclosure section có thể phù hợp hơn Methods, tùy tạp chí.

Case 3: Gray Area

Tình huống từ khung chương trình:

Reviewer dùng ChatGPT để giúp cấu trúc nhận xét phản biện. Reviewer không upload manuscript, chỉ viết tóm tắt bằng lời của mình và nhờ AI cải thiện độ rõ.

Câu hỏi thảo luận

- Có được phép không?

- Có cần hỏi editor không?

- Có nguy cơ bảo mật không?

- Nếu reviewer đưa quá nhiều thông tin từ manuscript vào prompt thì sao?

Gợi ý trả lời

Đây là vùng xám. Nếu tạp chí cấm dùng AI trong peer review thì không được. Nếu không cấm, reviewer vẫn cần bảo mật nghiêm ngặt, không đưa nội dung mật hoặc dữ liệu bản thảo chưa công bố vào công cụ công cộng. Tốt nhất là kiểm tra chính sách của tạp chí hoặc hỏi editor.

Thực hành 2: Write Disclosure Statements

Thời lượng: 20 phút

Theo khung chương trình, học viên sẽ liệt kê tất cả công cụ AI đã dùng, ghi rõ công cụ dùng cho việc gì, rồi viết disclosure cho ethics submission, Methods và Acknowledgments.

Bước 1: Lập bảng AI use inventory

| Công cụ | Dùng để làm gì? | Có dữ liệu bệnh nhân không? | Có ảnh hưởng phân tích không? | Cần khai báo ở đâu? |

|---|---|---|---|---|

| ChatGPT | Viết outline proposal | Không | Không | Acknowledgments nếu đáng kể |

| Elicit | Tìm bài literature review | Không | Có thể | Methods nếu systematic review |

| ChatGPT | Viết code Python | Dataset ẩn danh | Có | Methods |

| Paperpal | Chỉnh tiếng Anh | Manuscript | Không | Acknowledgments |

| Rayyan | AI screening | Abstract công khai | Có | Methods systematic review |

Bước 2: Viết disclosure cho Ethics submission

Nghiên cứu dự kiến sử dụng [tên công cụ] để hỗ trợ [mục đích]. Dữ liệu nhập vào công cụ sẽ được [ẩn danh/mã hóa/không chứa thông tin định danh]. Công cụ AI không được sử dụng để đưa ra quyết định lâm sàng trực tiếp. Nhóm nghiên cứu sẽ kiểm tra toàn bộ output và lưu nhật ký sử dụng AI.

Bước 3: Viết disclosure cho Methods

We used [Tool name, version] to assist with [specific task]. No identifiable patient data were entered into the tool. All AI-generated outputs were reviewed and verified by the authors before use.

Bước 4: Viết disclosure cho Acknowledgments

During manuscript preparation, [Tool name, version] was used to assist with language editing and improving clarity. The authors reviewed and edited all outputs and take full responsibility for the final content.

Thực hành 3: Consent Form Review

Thời lượng: 15 phút

Nhiệm vụ

Giảng viên cung cấp một consent form mẫu tiếng Việt. Học viên rà soát theo bảng:

| Mục cần có | Có/Không | Nhận xét | Cần sửa |

|---|---|---|---|

| Mục tiêu nghiên cứu | |||

| Quy trình tham gia | |||

| Tự nguyện tham gia | |||

| Quyền rút lui | |||

| Dữ liệu thu thập | |||

| Quyền riêng tư | |||

| Rủi ro | |||

| Lợi ích | |||

| Liên hệ nghiên cứu viên | |||

| Có dùng AI không? | |||

| Dữ liệu có đưa vào AI không? | |||

| Bảo mật khi dùng AI |

Prompt AI hỗ trợ hợp lý

Tôi có một consent form nghiên cứu y khoa đã được ẩn thông tin tổ chức và không chứa dữ liệu bệnh nhân.

Hãy rà soát xem consent form đã có đủ các mục sau chưa:

1. Mục tiêu nghiên cứu

2. Quy trình tham gia

3. Tự nguyện tham gia

4. Quyền rút lui

5. Dữ liệu thu thập

6. Rủi ro và lợi ích

7. Bảo mật dữ liệu

8. Người liên hệ

9. Nội dung liên quan đến sử dụng AI nếu nghiên cứu có AI

Hãy chỉ ra phần còn thiếu và gợi ý câu viết bổ sung bằng tiếng Việt dễ hiểu.

Thực hành 4: Bias Detection

Thời lượng: 15 phút

Tình huống

Một mô hình AI dự đoán tái nhập viện được huấn luyện bằng dữ liệu:

- 80% từ bệnh viện thành thị.

- 20% từ bệnh viện nông thôn.

- Outcome: tái nhập viện 30 ngày.

- Mục tiêu: dùng tại cả bệnh viện tỉnh và huyện.

Câu hỏi

- Bias nào có thể tồn tại?

- Làm sao phát hiện?

- Cần phân tích subgroup nào?

- Cần báo cáo gì trong manuscript?

- Có nên triển khai ngay không?

Gợi ý trả lời

Bias có thể gồm:

- Urban-rural bias.

- Referral bias.

- Socioeconomic bias.

- Missing data bias.

- Access-to-care bias.

- Measurement bias.

Cần kiểm tra:

- AUROC theo urban/rural.

- Sensitivity/specificity theo nhóm.

- Calibration theo nhóm.

- Tỷ lệ missing data theo nhóm.

- False negative ở nhóm nông thôn.

- External validation tại bệnh viện huyện.

PHẦN 12: CASE STUDY BỔ SUNG

Case 1: AI viết 80% manuscript

Một nhóm nghiên cứu có dữ liệu thật. Họ đưa kết quả vào AI và yêu cầu viết toàn bộ Introduction, Methods, Results, Discussion. Nhóm chỉ sửa nhẹ, không khai báo AI.

Câu hỏi

- Vấn đề là gì?

- Có cần khai báo không?

- Có nguy cơ plagiarism không?

- Tác giả có còn kiểm soát nội dung không?

- Cách làm đúng hơn là gì?

Gợi ý

Vấn đề chính là thiếu minh bạch, nguy cơ sai nội dung, mất tiếng nói tác giả, thiếu kiểm chứng, có thể vi phạm chính sách tạp chí. Cách đúng: dùng AI để gợi ý cấu trúc hoặc chỉnh ngôn ngữ, không copy nguyên văn; tác giả phải kiểm chứng toàn bộ và khai báo phù hợp.

Case 2: AI tạo code phân tích thống kê

Một bác sĩ dùng ChatGPT viết code R để chạy hồi quy logistic. Bác sĩ chạy code, copy kết quả vào bài báo nhưng không hiểu mô hình và không kiểm tra với thống kê viên.

Câu hỏi

- Có được dùng AI viết code không?

- Sai ở đâu?

- Nên khai báo thế nào?

- Ai chịu trách nhiệm nếu mô hình sai?

Gợi ý

Có thể dùng AI viết code, nhưng phải hiểu code, kiểm tra logic, kiểm tra kết quả, lưu prompt/code, và nên nhờ người có chuyên môn thống kê review. Nếu AI hỗ trợ phân tích, nên khai báo trong Methods. Tác giả chịu trách nhiệm.

Case 3: AI dịch phỏng vấn định tính

Nhóm nghiên cứu phỏng vấn bệnh nhân HIV. Họ dùng AI công cộng để dịch và tóm tắt transcript tiếng Việt sang tiếng Anh. Transcript đã bỏ tên nhưng còn nhiều chi tiết cá nhân, địa phương, gia đình.

Câu hỏi

- Transcript đã “bỏ tên” có đủ an toàn chưa?

- Có nguy cơ re-identification không?

- Có cần consent riêng cho xử lý bằng AI không?

- Cách làm an toàn hơn?

Gợi ý

Bỏ tên chưa đủ nếu nội dung còn chi tiết nhận diện. Cần đánh giá re-identification risk, loại bỏ/biến đổi thông tin gián tiếp, dùng công cụ được phê duyệt hoặc xử lý nội bộ, thông báo trong consent nếu AI xử lý dữ liệu định tính nhạy cảm.

Case 4: AI-generated image trong bài báo

Một nhóm dùng AI tạo hình minh họa cơ chế bệnh sinh và đưa vào Graphical Abstract, không khai báo.

Câu hỏi

- Có cần khai báo không?

- Cần kiểm tra chính sách tạp chí gì?

- Hình AI có thể gây sai lệch khoa học không?

- Có vấn đề bản quyền không?

Gợi ý

Cần kiểm tra chính sách tạp chí về AI-generated images. Cần khai báo nếu dùng. Tác giả phải đảm bảo hình không sai khoa học, không gây hiểu nhầm, không vi phạm bản quyền hoặc mô phỏng dữ liệu không có thật.

PHẦN 13: RESPONSIBLE AI USE CHECKLIST

Khung chương trình gốc chia checklist thành 3 giai đoạn: trước khi dùng AI, trong khi dùng AI và sau khi dùng/trước submission.

13.1. Trước khi dùng AI

- Kiểm tra chính sách AI của bệnh viện/trường.

- Kiểm tra chính sách của hội đồng đạo đức.

- Kiểm tra chính sách của tạp chí mục tiêu.

- Xác định mục đích dùng AI.

- Đánh giá có dữ liệu bệnh nhân không.

- Loại bỏ thông tin định danh.

- Dùng công cụ nội bộ nếu xử lý dữ liệu nhạy cảm.

- Chuẩn bị AI use log.

- Xác định ai kiểm tra output.

- Xác định cần khai báo ở đâu.

13.2. Trong khi dùng AI

- Lưu prompt và output quan trọng.

- Ghi tên công cụ, phiên bản, ngày dùng.

- Không đưa dữ liệu định danh vào AI công cộng.

- Không yêu cầu AI tạo dữ liệu giả cho nghiên cứu thật.

- Kiểm tra citation AI bằng PubMed/Google Scholar/DOI.

- Kiểm tra code AI viết.

- Kiểm tra bias và lỗi logic.

- Không để AI quyết định thay vấn đề đạo đức.

- Không copy nguyên văn nếu chưa chỉnh sửa và kiểm chứng.

13.3. Sau khi dùng AI / trước submission

- Khai báo AI ở vị trí phù hợp.

- Kiểm tra tất cả tài liệu tham khảo.

- Kiểm tra plagiarism.

- Xác nhận con người chịu trách nhiệm.

- Review chính sách AI của journal.

- Cập nhật AI use log.

- Đảm bảo không có dữ liệu định danh trong phụ lục/prompt/code.

- Đồng tác giả biết và đồng ý với disclosure.

- Sẵn sàng trả lời editor nếu được hỏi.

PHẦN 14: PROMPT THƯ VIỆN CHO BÀI 18

Prompt 1: Đánh giá rủi ro đạo đức khi dùng AI

Tôi dự định sử dụng AI trong nghiên cứu y khoa như sau:

- Mục tiêu nghiên cứu:

- Loại dữ liệu:

- Có dữ liệu bệnh nhân không:

- Dữ liệu đã ẩn danh chưa:

- Công cụ AI dự định dùng:

- AI dùng để làm gì:

- Output AI có ảnh hưởng đến phân tích/kết luận không:

- Có informed consent không:

- Có chính sách bệnh viện/tạp chí liên quan không:

Hãy đánh giá rủi ro đạo đức theo các nhóm:

1. Autonomy

2. Beneficence

3. Non-maleficence

4. Justice

5. Privacy/security

6. Transparency/disclosure

7. Accountability

8. Reproducibility

Hãy đề xuất biện pháp giảm thiểu rủi ro.

Prompt 2: Viết AI disclosure

Tôi đã sử dụng AI trong nghiên cứu như sau:

- Công cụ:

- Phiên bản nếu biết:

- Ngày sử dụng:

- Mục đích:

- Dữ liệu nhập vào:

- Output được dùng thế nào:

- Ai kiểm tra:

- Có dữ liệu bệnh nhân không:

- Có ảnh hưởng đến phân tích không:

Hãy viết 3 phiên bản disclosure:

1. Cho Methods

2. Cho Acknowledgments

3. Cho Ethics committee submission

Yêu cầu:

- Minh bạch

- Không phóng đại

- Nêu rõ tác giả chịu trách nhiệm

- Không thêm thông tin không có

Prompt 3: Rà soát consent form

Dưới đây là consent form đã ẩn thông tin tổ chức:

[Dán consent form]

Nghiên cứu có sử dụng AI để:

[Mô tả]

Hãy rà soát xem consent form đã đủ các mục sau chưa:

- Mục tiêu nghiên cứu

- Quy trình tham gia

- Tự nguyện tham gia

- Quyền rút lui

- Dữ liệu thu thập

- Bảo mật dữ liệu

- Sử dụng AI

- Rủi ro

- Lợi ích

- Liên hệ nghiên cứu viên

Hãy gợi ý câu bổ sung bằng tiếng Việt dễ hiểu cho bệnh nhân.

Prompt 4: Kiểm tra bias mô hình AI

Tôi có mô hình AI trong nghiên cứu y khoa:

- Outcome:

- Population:

- Nguồn dữ liệu:

- Tỷ lệ nhóm tuổi:

- Tỷ lệ giới:

- Tỷ lệ thành thị/nông thôn:

- Bệnh viện nguồn:

- Tỷ lệ missing data:

- Intended use:

- Metrics chung:

- Metrics theo subgroup nếu có:

Hãy đánh giá nguy cơ bias/fairness:

1. Nhóm nào có thể bị thiệt?

2. Cần phân tích subgroup nào?

3. Cần báo cáo metric nào?

4. Cần external validation ở đâu?

5. Có nên triển khai không?

6. Cần viết limitation thế nào?

Prompt 5: Kiểm tra AI use log

Dưới đây là AI use log của nhóm nghiên cứu:

[Dán bảng]

Hãy kiểm tra:

1. Có thiếu tên công cụ/phiên bản/ngày không?

2. Có tác vụ nào cần khai báo trong Methods không?

3. Có tác vụ nào chỉ cần Acknowledgments không?

4. Có nguy cơ bảo mật nào không?

5. Có output nào cần kiểm chứng thêm không?

6. Có điểm nào journal/editor có thể hỏi không?

7. Đề xuất bản disclosure tổng hợp.

PHẦN 15: LỖI THƯỜNG GẶP VÀ CÁCH SỬA

| Lỗi | Ví dụ | Hậu quả | Cách sửa |

|---|---|---|---|

| Không khai báo AI | Dùng AI viết manuscript nhưng không nói | Mất minh bạch | Khai báo theo chính sách tạp chí |

| Cho AI làm tác giả | “ChatGPT” trong author list | Vi phạm authorship | Ghi AI trong disclosure nếu có |

| Upload dữ liệu định danh | Dán bệnh án vào chatbot | Vi phạm bảo mật | Ẩn danh, dùng hệ thống được phê duyệt |

| Tin citation AI | Copy reference AI tạo | Citation giả | Kiểm tra PubMed/DOI |

| Không lưu prompt | Không nhớ đã dùng AI thế nào | Không tái lập được | AI use log |

| Không kiểm tra code AI | Chạy code sai | Kết quả sai | Review code, đối chiếu SPSS/R |

| AI viết conclusion quá mạnh | “Proves effectiveness” | Overclaim | Viết thận trọng |

| Không kiểm tra bias | Model kém ở nhóm nông thôn | Bất công | Subgroup performance |

| Dùng AI trong peer review | Upload manuscript của người khác | Vi phạm bảo mật | Kiểm tra chính sách editor |

| AI tạo dữ liệu giả | Bù dữ liệu thiếu | Fabrication | Tuyệt đối không làm |

PHẦN 16: CHECKLIST SAU BÀI HỌC

Checklist đạo đức nghiên cứu

- Có ethics approval hoặc lý do miễn phù hợp.

- Consent form rõ ràng.

- Người tham gia có quyền rút lui.

- Dữ liệu được mã hóa.

- Có kế hoạch bảo mật dữ liệu.

- Rủi ro và lợi ích được mô tả.

- Có người chịu trách nhiệm chính.

- Có kế hoạch xử lý sự cố dữ liệu.

- Có kiểm tra công bằng/bias nếu dùng AI.

- Có báo cáo limitation liên quan AI.

Checklist khai báo AI

- Đã liệt kê tất cả công cụ AI đã dùng.

- Đã ghi mục đích sử dụng từng công cụ.

- Đã ghi có/không dữ liệu bệnh nhân.

- Đã lưu prompt/output quan trọng.

- Đã kiểm tra citation AI.

- Đã kiểm tra code/output AI.

- Đã xác định khai báo ở Methods hay Acknowledgments.

- Đã kiểm tra chính sách journal.

- Đồng tác giả đã đồng ý với disclosure.

- Tác giả chịu trách nhiệm toàn bộ nội dung.

PHẦN 17: BÀI TẬP VỀ NHÀ

Bài tập chính: AI Ethics and Disclosure Package

Mỗi học viên chuẩn bị một bộ hồ sơ đạo đức AI cho đề tài của mình.

Yêu cầu nộp

- AI use inventory

- Công cụ AI đã dùng.

- Mục đích.

- Có dữ liệu bệnh nhân hay không.

- Output dùng thế nào.

- Ai kiểm chứng.

- AI use log

- Ít nhất 5 dòng hoặc toàn bộ công cụ đã dùng.

- Có tên công cụ, phiên bản nếu biết, ngày, prompt chính, output, người kiểm tra.

- Disclosure statements

- Một bản cho Methods.

- Một bản cho Acknowledgments.

- Một bản cho ethics committee submission.

- Consent form review

- Rà soát consent form hiện tại.

- Chỉ ra điểm thiếu liên quan dữ liệu/AI/bảo mật.

- Viết đoạn bổ sung nếu cần.

- Bias/fairness assessment

- Nếu đề tài có AI/model: đánh giá bias theo subgroup.

- Nếu đề tài không có AI/model: đánh giá bias do dùng AI trong literature/writing/analysis.

- Reflection 200–300 từ

- Rủi ro đạo đức lớn nhất trong đề tài của bạn là gì?

- Bạn đã giảm thiểu rủi ro ra sao?

- AI giúp gì nhưng cũng có thể gây hại ở đâu?

- Bạn sẽ khai báo AI thế nào nếu gửi bài?

Mẫu bài nộp rút gọn

Tên đề tài:

Tỷ lệ burnout và các yếu tố liên quan ở điều dưỡng ICU tại Bệnh viện X.

AI tools used:

1. ChatGPT: gợi ý outline Introduction, không có dữ liệu bệnh nhân.

2. Elicit: tìm bài liên quan, tất cả citation kiểm tra lại bằng PubMed.

3. Paperpal: chỉnh ngữ pháp tiếng Anh manuscript.

4. ChatGPT: viết code Python mô tả dữ liệu, dataset đã ẩn danh.

Disclosure for Acknowledgments:

During the preparation of this manuscript, ChatGPT and Paperpal were used to assist with manuscript structure and language editing. The authors reviewed and edited all AI-assisted outputs and take full responsibility for the final content.

Disclosure for Methods:

ChatGPT was used to assist in generating Python code for descriptive statistical analysis. The code and outputs were independently verified by the study team using SPSS. No identifiable patient data were entered into the AI tool.

Main ethical concern:

Dữ liệu nghiên cứu gồm thông tin nhân viên y tế trong cùng bệnh viện, có nguy cơ nhận diện gián tiếp. Nhóm nghiên cứu sẽ mã hóa dữ liệu, báo cáo kết quả ở dạng tổng hợp và không công bố thông tin khoa/phòng có thể làm lộ danh tính.

PHẦN 18: RUBRIC CHẤM ĐIỂM

| Tiêu chí | Điểm |

|---|---|

| AI use inventory đầy đủ | 1 |

| AI use log rõ, có khả năng audit | 1.5 |

| Disclosure Methods phù hợp | 1.5 |

| Disclosure Acknowledgments phù hợp | 1 |

| Ethics committee disclosure phù hợp | 1 |

| Consent form review thực tế | 1 |

| Bias/fairness assessment có lập luận | 1 |

| Nhận diện đúng red flags | 1 |

| Reflection sâu, có trách nhiệm | 1 |

| Tổng | 10 |

PHẦN 19: THÔNG ĐIỆP KẾT THÚC

Bài 18 là bài giữ cho toàn bộ hành trình nghiên cứu với AI đi đúng đường.

Hãy nhớ 8 câu:

1. AI không thể là tác giả, không thể chịu trách nhiệm, không thể ký cam kết đạo đức.

2. Tác giả chịu trách nhiệm 100% cho nội dung, dữ liệu, phân tích, citation và kết luận.

3. Dữ liệu bệnh nhân không phải nguyên liệu để thử chatbot công cộng.

4. Dùng AI không xấu; giấu AI hoặc dùng AI không kiểm soát mới nguy hiểm.

5. Disclosure tốt là disclosure cụ thể: dùng công cụ gì, làm gì, ai kiểm tra.

6. Bias không tự biến mất vì mô hình gọi là AI. Đôi khi AI chỉ làm bias mặc áo blouse trắng hơn.

7. Consent form cần nói đủ để người tham gia hiểu dữ liệu của họ được dùng thế nào.

8. Nghiên cứu tốt không chỉ publish được; nghiên cứu tốt còn phải bảo vệ được người tham gia, tác giả và niềm tin khoa học.

Soạn giả: Jack Doan

Phiên bản: 1.0

- Đăng nhập để gửi ý kiến