🎯 MỤC TIÊU

Về kiến thức (Knowledge):

Liệt kê được ít nhất 5 lợi ích cụ thể của AI ở các giai đoạn nghiên cứu khác nhau

Nhận diện được 6 rủi ro chính khi sử dụng AI: hallucination, bias, vi phạm bảo mật, plagiarism, mất tư duy phản biện, và tài liệu giả

Áp dụng được 4 nguyên tắc đạo đức y sinh học (Beneficence, Non-maleficence, Autonomy, Justice) vào việc sử dụng AI

Về kỹ năng (Skills): 4. Phát hiện được tài liệu tham khảo giả do AI tạo ra (fake citations) 5. Đánh giá được tính tin cậy của câu trả lời từ AI 6. Xây dựng được quy trình kiểm tra (verification workflow) khi sử dụng AI

Về thái độ (Attitude): 7. Phát triển tư duy phản biện (critical thinking) khi sử dụng AI 8. Cam kết sử dụng AI có trách nhiệm trong nghiên cứu

🌟 PHẦN 1: LỢI ÍCH CỦA AI - NHỮNG GÌ AI THỰC SỰ MANG LẠI

Trước khi nói về rủi ro, hãy hiểu rõ AI thực sự giúp được gì. Có hiểu lợi ích, bạn mới quyết định được khi nào nên dùng và khi nào không.

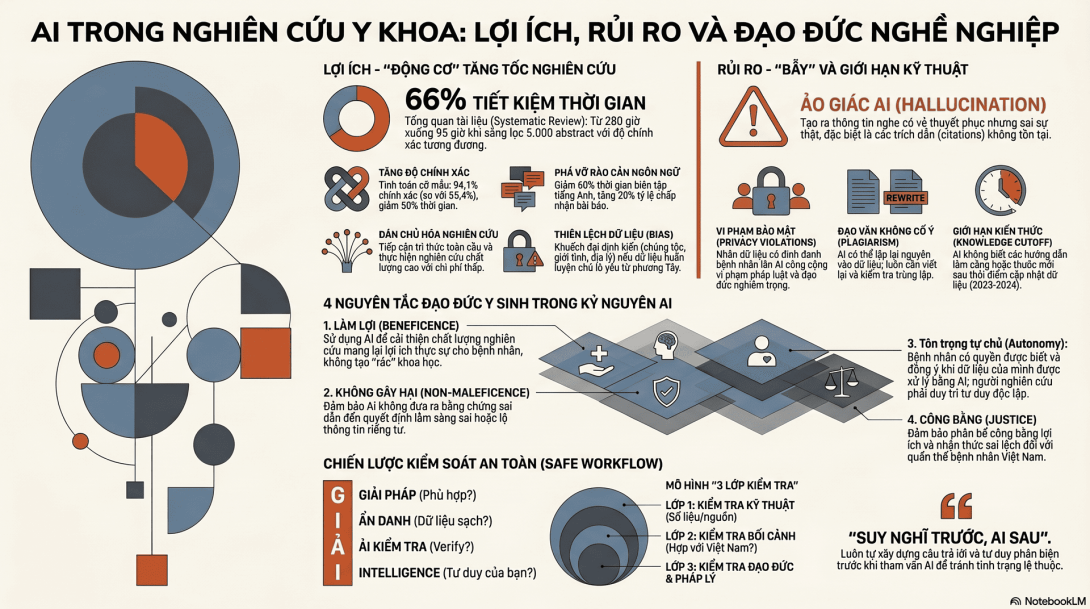

1.1. Lợi ích #1: Tiết kiệm thời gian đáng kể

Đây là lợi ích rõ ràng và có thể đo lường được nhất. Nhưng tiết kiệm bao nhiêu? Hãy xem dữ liệu cụ thể từ các nghiên cứu đã công bố:

Bằng chứng khoa học cụ thể:

Trong tổng quan tài liệu (Systematic Review):

Một nghiên cứu công bố trên BMC Medical Research Methodology (2024) so sánh 2 nhóm nghiên cứu viên thực hiện screening 5,000 abstracts:

- Nhóm truyền thống: Mất trung bình 280 giờ (2 người, 4 tháng)

- Nhóm có AI (Rayyan): Mất 95 giờ (2 người, 6 tuần)

- Tiết kiệm: ~66% thời gian

- Độ chính xác: Tương đương (Cohen's kappa = 0.85)

Trong tính cỡ mẫu (Sample Size Calculation):

Nghiên cứu PowerGPT (arXiv 2024) so sánh chính xác giữa con người và AI:

- Bác sĩ tự tính: 55.4% chính xác

- AI hỗ trợ: 94.1% chính xác

- Thời gian: 9.3 phút (người) vs 4 phút (AI)

Trong viết bài báo tiếng Anh:

Khảo sát của Paperpal (2024) trên 500 nhà nghiên cứu non-native English:

- Thời gian viết Introduction giảm 35-45%

- Thời gian editing giảm 60%

- Tỷ lệ accept của tạp chí (vòng đầu): tăng 20%

1.2. Lợi ích #2: Cải thiện độ chính xác (ở một số khâu cụ thể)

Một quan niệm sai lầm phổ biến: "AI chỉ tăng tốc, không tăng chất lượng".

Sự thật: Ở một số khâu, AI thực sự làm tốt hơn con người. Cụ thể:

Ở những khâu AI làm tốt hơn:

- Tính toán phức tạp: Sample size, statistical analysis (ít sai số tính toán)

- Kiểm tra ngữ pháp tiếng Anh: Phát hiện lỗi mà mắt người bỏ qua

- Sàng lọc nhanh: AI đọc 1000 abstracts trong 1 giờ, người không thể

- Tìm pattern trong dữ liệu lớn: Mối liên hệ con người khó nhận ra

Ở những khâu AI KHÔNG làm tốt bằng người:

- Hiểu context lâm sàng cụ thể: AI không biết "bệnh nhân này có hoàn cảnh khó khăn"

- Đánh giá tính sáng tạo của ý tưởng: AI chỉ tổng hợp, không sáng tạo thật sự

- Quyết định đạo đức: AI không có "lương tâm"

- Đánh giá tính khả thi tại Việt Nam: AI có thể không hiểu hệ thống y tế VN

1.3. Lợi ích #3: Mở rộng khả năng tiếp cận tri thức

Đây là lợi ích lớn nhất cho Việt Nam, có thể nhiều bạn chưa nhận ra.

Hãy so sánh tình huống:

Bác sĩ A (BV Trung ương Hà Nội):

- Có subscription trường ĐH Y → đọc được mọi tạp chí

- Tiếng Anh tốt → đọc được paper gốc

- Đồng nghiệp giàu kinh nghiệm nghiên cứu

Bác sĩ B (BV Huyện ở vùng sâu):

- Không có subscription → chỉ đọc được abstract

- Tiếng Anh hạn chế → đọc rất chậm

- Ít người hỗ trợ chuyên môn

Trước thời AI: Khoảng cách giữa A và B rất lớn.

Với AI:

- Bác sĩ B có thể dùng Consensus (free) để hiểu state-of-art

- Dùng Claude để dịch và giải thích paper

- Hỏi ChatGPT về thiết kế nghiên cứu

- Khoảng cách thu hẹp đáng kể

💡 AI là "người thầy ảo" cho mọi nhân viên y tế Việt Nam, đặc biệt ở tuyến tỉnh và huyện.

1.4. Lợi ích #4: Hỗ trợ ngôn ngữ - Phá vỡ rào cản tiếng Anh

Đây là lợi ích đặc biệt quan trọng cho người Việt:

Trước AI:

- Bác sĩ Việt Nam có ý tưởng hay nhưng không thể viết bằng tiếng Anh tốt

- Phải thuê dịch giả ($200-500/bài) - tốn kém

- Hoặc submit và bị reject vì "language issues"

Với AI:

- Viết draft bằng tiếng Việt → AI dịch sang tiếng Anh

- Tự viết tiếng Anh → AI cải thiện văn phong

- Chi phí: $10-20/tháng cho công cụ

- Chất lượng: Có thể đạt mức "near-native"

Câu chuyện thực:

Một nghiên cứu sinh ở ĐH Y Hà Nội (2024) chia sẻ: "Trước đây tôi mất 3 tháng viết một bài báo tiếng Anh, và vẫn bị reviewer chê 'unclear English'. Bây giờ với Paperpal + Claude, tôi viết trong 1 tháng và bài đầu tiên đã được accept ở tạp chí Q2."

1.5. Lợi ích #5: Dân chủ hóa nghiên cứu khoa học

Đây là lợi ích mang tính cách mạng:

Khái niệm "dân chủ hóa nghiên cứu":

Trước đây, làm nghiên cứu chất lượng cao đòi hỏi:

- PhD hoặc đào tạo chuyên sâu

- Đội ngũ thống kê viên

- Kết nối với chuyên gia toàn cầu

- Tài chính lớn

Với AI, nhiều rào cản này được hạ thấp đáng kể.

Cụ thể tại Việt Nam:

- Một điều dưỡng có ý tưởng tốt → có thể tự thực hiện nghiên cứu nhỏ

- Một bác sĩ vùng sâu → có thể đóng góp vào tri thức toàn cầu

- Một sinh viên y → có thể bắt đầu nghiên cứu sớm hơn

✅ CHECKPOINT 1: Phân tích cá nhân

Hãy dừng lại và suy nghĩ:

Trong 5 lợi ích trên, lợi ích nào quan trọng nhất với bạn? Tại sao?

Có lợi ích nào khác mà bài chưa đề cập không?

Trong nghiên cứu hiện tại của bạn, bạn nghĩ AI có thể giúp tiết kiệm bao nhiêu thời gian? Ước lượng cụ thể.

⚠️ PHẦN 2: RỦI RO VÀ HẠN CHẾ CỦA AI - NHỮNG GÌ BẠN PHẢI BIẾT

Phần này là trái tim của bài học. Đây là những gì khiến AI có thể trở thành con dao hai lưỡi.

2.1. Rủi ro #1: HALLUCINATION - "Ảo giác" của AI

Đây là rủi ro nguy hiểm nhất và phổ biến nhất.

Định nghĩa:

Hallucination (Ảo giác AI): Hiện tượng AI tạo ra thông tin nghe có vẻ chính xác nhưng hoàn toàn sai sự thật, đôi khi là bịa hoàn toàn.

Tại sao AI bị "hallucinate"?

Để hiểu, hãy biết AI hoạt động như thế nào:

AI ngôn ngữ (như ChatGPT) không "biết" sự thật - chúng dự đoán "từ tiếp theo nên là gì" dựa trên xác suất.

Ví dụ đơn giản:

- Bạn hỏi: "Aspirin có tác dụng phụ gì?"

- AI nghĩ: "Câu này thường được tiếp theo bằng các từ như 'xuất huyết, loét dạ dày, dị ứng...'"

- AI trả lời các từ có xác suất cao nhất

Vấn đề: Khi AI không "biết" câu trả lời đúng, nó vẫn tự tin tạo ra câu trả lời nghe rất hợp lý nhưng có thể hoàn toàn sai.

Ví dụ thực tế đáng sợ:

Ví dụ 1: Tài liệu tham khảo giả

Đây là ví dụ kinh điển. Hãy thử hỏi ChatGPT:

Tôi cần 5 bài báo về "kháng kháng sinh ở bệnh nhân viêm phổi tại Việt Nam"

xuất bản trong 5 năm gần đây. Hãy cung cấp với đầy đủ tác giả, năm, tạp chí,

và DOI.

Kết quả thường thấy: ChatGPT sẽ tự tin liệt kê 5 bài, ví dụ:

Nguyen TH, et al. (2022). "Antimicrobial resistance patterns in community-acquired pneumonia in Vietnam." Vietnamese Journal of Medicine, 45(3), 234-245. DOI: 10.1234/vjm.2022.045

Vấn đề: Bài báo này KHÔNG TỒN TẠI. Tác giả không có thật, DOI không hợp lệ, tạp chí có thể không có volume đó.

⚠️ Đây là lý do bạn phải VERIFY MỌI TÀI LIỆU THAM KHẢO từ AI trên PubMed/Google Scholar.

Ví dụ 2: Sự kiện y khoa giả

Hỏi: "Cho tôi biết về thử nghiệm lâm sàng VINCENT-2024 về điều trị COVID-19"

AI có thể trả lời chi tiết về một thử nghiệm hoàn toàn không có thật, kèm con số, kết quả, và kết luận đầy thuyết phục.

Ví dụ 3: Liều thuốc sai

Hỏi: "Liều khởi đầu của thuốc X cho trẻ em là gì?"

AI có thể trả lời với liều sai khác so với hướng dẫn chính thức, đặc biệt với các thuốc mới hoặc ít phổ biến.

Cách phát hiện hallucination:

5 dấu hiệu cảnh báo:

Quá cụ thể: AI đưa ra số liệu chính xác đến 2 chữ số thập phân cho dữ liệu khó có

Không có nguồn: Không trích dẫn tạp chí cụ thể, hoặc trích dẫn không thể verify

Quá hoàn hảo: Câu trả lời "fit" quá tốt với câu hỏi của bạn

Kiến thức hiếm: Bạn hỏi về chủ đề rất chuyên sâu nhưng AI trả lời như chuyên gia

Kiến thức cập nhật: AI đưa thông tin về sự kiện sau "knowledge cutoff" của nó

Quy tắc vàng:

🚨 MỌI thông tin về số liệu, tài liệu tham khảo, sự kiện cụ thể từ AI phải được VERIFY trên nguồn chính thống.

2.2. Rủi ro #2: BIAS - Thiên lệch của AI

Định nghĩa:

Bias (Thiên lệch): AI có thể tái tạo và khuếch đại các thiên lệch có sẵn trong dữ liệu huấn luyện.

Tại sao AI bị bias?

AI học từ dữ liệu. Nếu dữ liệu thiên lệch, AI sẽ thiên lệch theo.

Các loại bias phổ biến:

a) Bias chủng tộc/dân tộc

Câu chuyện kinh điển: Năm 2019, một nghiên cứu trên Science phát hiện thuật toán AI dự đoán nguy cơ sức khỏe (đang được dùng ở Mỹ cho 70 triệu bệnh nhân) đánh giá thấp nguy cơ ở người da đen so với người da trắng có cùng tình trạng. Lý do: AI học từ dữ liệu chi phí y tế, mà người da đen ít tiếp cận y tế hơn → chi phí thấp hơn → AI nghĩ "sức khỏe tốt hơn".

Áp dụng vào Việt Nam: Nếu AI được train chủ yếu trên dữ liệu Caucasian (da trắng):

- Có thể không chính xác cho bệnh nhân Việt Nam

- Ví dụ: BMI cut-off cho béo phì khác nhau giữa Asian và Caucasian

- Cần thận trọng khi áp dụng AI tools vào quần thể VN

b) Bias giới tính

Ví dụ: AI được train chủ yếu trên nghiên cứu lâm sàng có 70% nam giới (đặc biệt nghiên cứu tim mạch trước 2000s) → AI có thể không hiểu rõ triệu chứng nhồi máu cơ tim ở phụ nữ (thường khác với nam).

c) Bias địa lý

Phần lớn dữ liệu y khoa đến từ các nước phương Tây → AI có thể không phù hợp với:

- Bệnh nhiệt đới (sốt xuất huyết, sốt rét)

- Hệ thống y tế đang phát triển

- Khía cạnh văn hóa của chăm sóc bệnh nhân

d) Bias xác nhận (Confirmation bias)

AI thường "đồng ý" với câu hỏi của bạn. Nếu bạn hỏi: "Vitamin D có tốt cho bệnh nhân X không?", AI có xu hướng tìm bằng chứng "có" nhiều hơn "không".

Cách giảm thiểu bias:

Hỏi cả hai mặt: "Vitamin D có tốt và có hại cho bệnh nhân X không?"

Yêu cầu AI: "Hãy đưa ra cả bằng chứng ủng hộ và phản đối"

Verify trên nhiều nguồn khác nhau

Nhận thức về quần thể nghiên cứu

2.3. Rủi ro #3: VI PHẠM BẢO MẬT - Privacy violations

Đây là rủi ro lớn nhất về mặt pháp lý và đạo đức.

Vấn đề:

Khi bạn nhập thông tin vào ChatGPT:

- Dữ liệu được gửi đến server của OpenAI (Mỹ)

- Có thể được dùng để train mô hình tiếp theo

- Có thể được lưu trữ vô thời hạn

- Có thể bị truy cập bởi nhân viên OpenAI

Tình huống nguy hiểm:

❌ KHÔNG được làm:

"Bệnh nhân Nguyễn Văn A, 45 tuổi, MBA 1234567, nhập viện ngày 15/3/2024

với triệu chứng đau ngực. Tiền sử: tăng huyết áp, đái tháo đường type 2.

Hãy phân tích ca này và đưa ra chẩn đoán phân biệt."

Lý do:

- Vi phạm quyền riêng tư bệnh nhân

- Vi phạm Luật Khám chữa bệnh Việt Nam

- Vi phạm các thỏa thuận đạo đức nghề nghiệp

- Có thể bị truy cứu trách nhiệm pháp lý

✅ Được làm:

"Một bệnh nhân nam 45 tuổi, có tiền sử tăng huyết áp và đái tháo đường,

nhập viện vì đau ngực. Hãy phân tích các chẩn đoán phân biệt cần xem xét."

Khác biệt: Không có thông tin định danh bệnh nhân.

Quy tắc bảo mật:

Quy tắc 1: Loại bỏ MỌI thông tin định danh trước khi nhập vào AI

Thông tin định danh bao gồm (theo HIPAA):

- Tên, ngày sinh đầy đủ

- Mã bệnh án (MBA), số bảo hiểm

- Địa chỉ chi tiết

- Số điện thoại, email

- Ngày khám/nhập viện cụ thể

- Hình ảnh có thể nhận diện (X-quang có tên)

Quy tắc 2: Phân biệt AI công cộng vs AI bệnh viện

| Loại AI | Đặc điểm | Phù hợp với |

|---|---|---|

| AI công cộng (ChatGPT.com, Claude.ai) | Server cloud, không kiểm soát dữ liệu | Câu hỏi tổng quát, không có dữ liệu BN |

| AI doanh nghiệp (ChatGPT Enterprise, Claude for Teams) | Cam kết không train, có audit trail | Có thể dùng cho dữ liệu nội bộ |

| AI on-premise (cài đặt tại bệnh viện) | Dữ liệu không ra ngoài | An toàn nhất cho dữ liệu BN |

Quy tắc 3: Tham khảo chính sách bệnh viện

Trước khi dùng AI cho công việc, hãy hỏi:

- Bệnh viện có chính sách về AI không?

- Có AI được approve không?

- IRB (Hội đồng Đạo đức) có yêu cầu khai báo không?

2.4. Rủi ro #4: PLAGIARISM - Đạo văn không cố ý

Vấn đề:

Khi AI tạo ra văn bản, nó có thể:

- Reproduce lại đúng câu từ trong dữ liệu huấn luyện

- Bạn vô tình copy-paste → thành đạo văn

- Phần mềm chống đạo văn (Turnitin, iThenticate) có thể phát hiện

Tình huống điển hình:

Bác sĩ X dùng ChatGPT viết Introduction cho bài báo. AI viết một đoạn rất hay. Bác sĩ X copy nguyên văn. Khi gửi cho tạp chí, Turnitin phát hiện 30% trùng lặp với một bài báo đã xuất bản năm 2020.

Lý do: ChatGPT có thể đã được train trên bài báo đó và "nhớ" nguyên văn.

Cách phòng tránh:

Không bao giờ copy-paste nguyên văn từ AI

Luôn rewrite bằng từ ngữ của mình

Chạy plagiarism check trước khi nộp (Grammarly Premium, Turnitin)

Khai báo việc dùng AI theo ICMJE guidelines

2.5. Rủi ro #5: MẤT TƯ DUY PHẢN BIỆN - "Lười suy nghĩ"

Đây là rủi ro tinh vi nhưng nguy hiểm.

Hiện tượng "AI dependency":

Câu chuyện thực: Một nghiên cứu sinh tâm sự: "Trước đây tôi đọc paper rất kỹ, suy nghĩ về thiết kế nghiên cứu. Bây giờ tôi chỉ paste abstract vào ChatGPT và hỏi 'tóm tắt giúp', 'đánh giá thiết kế giúp'. Tôi cảm thấy mình đang mất khả năng tự suy nghĩ."

Tác hại:

- Kỹ năng critical appraisal giảm sút

- Không phát hiện được lỗi của AI

- Trở nên phụ thuộc vào AI

- Khi AI không có sẵn → không biết làm

Phép thử "lười suy nghĩ":

Hãy thành thật trả lời:

Khi AI đưa ra câu trả lời, bạn có đọc kỹ và đánh giá không, hay chỉ copy-paste?

Bạn có so sánh câu trả lời AI với kiến thức của mình không?

Bạn có đặt câu hỏi phản biện với AI không?

Bạn có thể làm tác vụ này không có AI không?

Nếu trả lời "không" cho 2 câu trở lên → Bạn đang bị "AI dependency".

Cách phòng tránh:

Nguyên tắc "Suy nghĩ trước, AI sau":

Trước khi hỏi AI, hãy tự suy nghĩ và viết ra câu trả lời của mình

Sau đó hỏi AI

So sánh: Có gì khác? Tại sao khác? Ai đúng?

Học từ sự khác biệt

Nguyên tắc "Học một, dùng một":

- Một tác vụ bạn dùng AI

- Một tác vụ tương tự bạn tự làm

- Đảm bảo bạn vẫn duy trì kỹ năng

2.6. Rủi ro #6: KIẾN THỨC CŨ - Knowledge Cutoff

Vấn đề:

Mỗi mô hình AI có một "knowledge cutoff" - thời điểm dữ liệu huấn luyện kết thúc.

| AI Model | Knowledge Cutoff (ước tính) |

|---|---|

| ChatGPT (GPT-4) | Tháng 4/2023 - 4/2024 |

| Claude 3.5 | Tháng 4/2024 |

| Gemini Pro | Tháng 12/2023 |

Hệ quả:

- AI không biết về:

- Hướng dẫn lâm sàng mới (sau cutoff)

- Thuốc mới được FDA approve

- Các nghiên cứu/RCT mới công bố

- Các đại dịch hoặc sự kiện y tế gần đây

Ví dụ:

Hỏi ChatGPT: "Hướng dẫn mới nhất của ESC 2024 về suy tim?"

AI có thể trả lời ESC 2021 hoặc bịa ra "ESC 2024" (hallucination).

Cách giải quyết:

Luôn xác nhận thời gian: Hỏi "Knowledge cutoff của bạn là khi nào?"

Dùng AI có web search: Perplexity, ChatGPT với web browsing

Verify với nguồn chính thức: PubMed, guidelines website

Cẩn thận với thông tin cập nhật: Hướng dẫn lâm sàng, thuốc mới

✅ CHECKPOINT 2: Tự đánh giá rủi ro

Hãy đánh giá các tình huống sau:

Tình huống A: "Tôi dùng ChatGPT viết Introduction, AI cho 5 references đẹp. Tôi copy luôn vào bài và submit."

→ Bao nhiêu rủi ro xuất hiện? Liệt kê.

Tình huống B: "Tôi paste hồ sơ bệnh nhân (đã ẩn tên) lên ChatGPT để hỏi chẩn đoán phân biệt."

→ Đây có an toàn không? Tại sao?

Tình huống C: "Tôi hỏi ChatGPT về 'guidelines mới nhất 2025 về điều trị tăng huyết áp', AI trả lời rất chi tiết."

→ Bạn có tin không? Cần kiểm tra gì?

🎓 PHẦN 3: 4 NGUYÊN TẮC ĐẠO ĐỨC Y SINH HỌC ÁP DỤNG CHO AI

Bây giờ chúng ta chuyển sang khung lý thuyết đạo đức. Đây là phần quan trọng vì nó giúp bạn ra quyết định trong những tình huống mới.

3.1. Bối cảnh: Đạo đức y sinh học là gì?

Beauchamp & Childress (1979) đề xuất 4 nguyên tắc đạo đức y sinh học, được công nhận là chuẩn vàng quốc tế:

Beneficence (Làm lợi)

Non-maleficence (Không gây hại)

Autonomy (Tôn trọng tự chủ)

Justice (Công bằng)

Khi áp dụng AI vào nghiên cứu y khoa, cả 4 nguyên tắc này đều có hiệu lực.

3.2. Nguyên tắc 1: BENEFICENCE - Làm lợi

Ý nghĩa:

Mọi hành động (bao gồm sử dụng AI) phải nhằm mang lại lợi ích cho bệnh nhân, cộng đồng, và sự phát triển khoa học.

Áp dụng vào nghiên cứu với AI:

Câu hỏi tự kiểm tra:

- Việc tôi dùng AI có giúp cải thiện chất lượng nghiên cứu không?

- Kết quả nghiên cứu có mang lại lợi ích thực sự cho bệnh nhân không?

- Tôi có đang dùng AI để đẩy nhanh tiến độ một cách có chất lượng, hay chỉ để "qua loa"?

Ví dụ tích cực:

✅ Dùng AI tổng hợp 100 bài báo để xây dựng evidence-based protocol cho khoa của mình → Lợi ích trực tiếp cho bệnh nhân.

Ví dụ tiêu cực:

❌ Dùng AI viết 10 bài báo "rác" trong 1 năm để tăng số lượng publication → Không mang lại lợi ích thực, chỉ làm "ô nhiễm" tri thức khoa học.

3.3. Nguyên tắc 2: NON-MALEFICENCE - Không gây hại

"Primum non nocere" - "Trước hết, không gây hại"

- Câu châm ngôn cổ xưa của Hippocrates

Ý nghĩa:

AI có thể gây hại theo nhiều cách. Trách nhiệm của bạn là giảm thiểu mọi nguy cơ tổn hại.

Các "nguy cơ gây hại" cụ thể:

Hại với bệnh nhân:

- AI tạo ra evidence sai → quyết định lâm sàng sai → bệnh nhân bị hại

- Vi phạm bảo mật → bệnh nhân bị tổn thương danh dự, mất công việc

Hại với cộng đồng khoa học:

- Bài báo có hallucination được xuất bản → lan truyền thông tin sai

- Tài liệu tham khảo giả → người khác trích dẫn → "ô nhiễm" tri thức

Hại với chính bạn:

- Vi phạm đạo đức → mất uy tín nghề nghiệp

- Vi phạm pháp luật → trách nhiệm pháp lý

Quy trình giảm thiểu hại:

Bước 1: Trước khi dùng AI, đặt câu hỏi: "Cách dùng này có thể gây hại cho ai không?"

Bước 2: Nếu CÓ → Thiết kế biện pháp giảm thiểu (ví dụ: ẩn danh dữ liệu, verify kết quả).

Bước 3: Nếu rủi ro vẫn cao → KHÔNG dùng AI cho tác vụ này.

3.4. Nguyên tắc 3: AUTONOMY - Tôn trọng tự chủ

Ý nghĩa:

Tôn trọng quyền tự quyết của:

- Bệnh nhân (về việc tham gia nghiên cứu)

- Đồng nghiệp (về việc cộng tác)

- Bản thân (về việc duy trì tư duy độc lập)

Áp dụng cụ thể:

Với bệnh nhân:

- Nếu nghiên cứu dùng AI để xử lý dữ liệu BN → Phải có informed consent (đồng ý có thông tin) rằng AI sẽ được sử dụng

- BN có quyền từ chối dữ liệu của họ được dùng cho training AI

Với đồng nghiệp:

- Không upload bài báo đang peer review của người khác lên AI (vi phạm bảo mật)

- Khai báo việc dùng AI khi cộng tác

Với bản thân:

- Duy trì khả năng suy nghĩ độc lập

- Không để AI thay thế tư duy phản biện

- Có ý kiến riêng, không "đồng ý mặc định" với AI

Tình huống đạo đức điển hình:

Tình huống: Một bệnh viện muốn dùng AI để phân tích hồ sơ bệnh án của 10,000 bệnh nhân (đã có consent điều trị, chưa có consent cho AI). Có được không?

Trả lời: KHÔNG, trừ khi:

- IRB phê duyệt

- BN được thông báo và có thể opt-out

- Dữ liệu được ẩn danh đầy đủ

- AI được dùng phù hợp với mục đích ban đầu

3.5. Nguyên tắc 4: JUSTICE - Công bằng

Ý nghĩa:

Đảm bảo phân bổ công bằng lợi ích và rủi ro của AI.

Các vấn đề công bằng cụ thể:

a) Công bằng tiếp cận:

ChatGPT Plus = $20/tháng = ~500,000 VNĐ.

- Bác sĩ ở TP lớn có thể trả được

- Bác sĩ ở vùng sâu có thể không → Tạo ra khoảng cách kỹ thuật số trong y tế.

Giải pháp:

- Sử dụng phiên bản miễn phí khi có thể

- Bệnh viện cung cấp license cho nhân viên

- Chia sẻ kiến thức để mọi người cùng tiếp cận

b) Công bằng trong dữ liệu:

Nếu AI được train chủ yếu trên dữ liệu da trắng/nam giới/giàu có → Áp dụng vào BN châu Á/nữ/nghèo có thể không chính xác.

Giải pháp:

- Nhận thức về bias trong AI

- Verify kết quả AI với quần thể VN cụ thể

- Đóng góp vào việc xây dựng dữ liệu y tế VN

c) Công bằng tác giả:

Nếu một nghiên cứu có cả người Việt (làm hầu hết công việc) và người nước ngoài (chỉ supervise + dùng AI hỗ trợ), ai được làm tác giả chính?

Nguyên tắc: Theo ICMJE - tác giả phải có đóng góp thực sự (intellectual contribution), không phải đóng góp "AI-mediated".

✅ CHECKPOINT 3: Phân tích đạo đức

Hãy phân tích tình huống sau theo 4 nguyên tắc:

Tình huống: Bác sĩ Nam, công tác tại BV tỉnh, dùng ChatGPT phân tích 500 hồ sơ bệnh án (chưa ẩn danh) của bệnh nhân tăng huyết áp để tìm pattern mới. Anh chia sẻ phương pháp này tại hội nghị, gợi ý đồng nghiệp làm tương tự.

Câu hỏi:

Vi phạm nguyên tắc Beneficence như thế nào?

Vi phạm Non-maleficence ở điểm nào?

Vi phạm Autonomy của bệnh nhân ra sao?

Vấn đề Justice là gì?

(Đáp án ở cuối bài.)

🛡️ PHẦN 4: XÂY DỰNG QUY TRÌNH KIỂM TRA AN TOÀN

Bây giờ chúng ta đã hiểu lợi ích, rủi ro, và nguyên tắc đạo đức. Bước tiếp theo: xây dựng workflow cụ thể để dùng AI an toàn.

4.1. Mô hình "3 lớp kiểm tra"

Mọi sản phẩm từ AI nên qua 3 lớp kiểm tra:

┌──────────────────────────────────────────┐

│ LỚP 1: KIỂM TRA TÍNH CHÍNH XÁC │

│ - Có hallucination không? │

│ - Tài liệu tham khảo có thật không? │

│ - Số liệu có đúng không? │

└──────────────────────────────────────────┘

↓ (PASS)

┌──────────────────────────────────────────┐

│ LỚP 2: KIỂM TRA TÍNH ÁP DỤNG │

│ - Có phù hợp với bối cảnh VN không? │

│ - Có phù hợp với BN của tôi không? │

│ - Có cập nhật không? │

└──────────────────────────────────────────┘

↓ (PASS)

┌──────────────────────────────────────────┐

│ LỚP 3: KIỂM TRA ĐẠO ĐỨC │

│ - Có vi phạm nguyên tắc nào không? │

│ - Có cần khai báo không? │

│ - Có gây hại tiềm năng không? │

└──────────────────────────────────────────┘

↓ (PASS)

✅ SẴN SÀNG SỬ DỤNG

4.2. Checklist cụ thể cho từng tác vụ

Checklist khi dùng AI viết bài báo:

- [ ] Tôi đã viết draft bằng tư duy của mình trước khi dùng AI?

- [ ] Tôi đã verify TẤT CẢ tài liệu tham khảo trên PubMed?

- [ ] Tôi đã rewrite bằng từ ngữ của mình (không copy-paste)?

- [ ] Tôi đã chạy plagiarism check?

- [ ] Tôi đã khai báo việc dùng AI trong Acknowledgment?

Checklist khi dùng AI phân tích dữ liệu:

- [ ] Dữ liệu đã được ẩn danh trước khi nhập?

- [ ] Tôi hiểu code AI tạo ra (không chỉ copy-paste)?

- [ ] Tôi đã verify kết quả bằng phần mềm khác (SPSS, R)?

- [ ] Tôi đã kiểm tra logic của phân tích?

- [ ] IRB có yêu cầu khai báo việc dùng AI không?

Checklist khi dùng AI tổng quan tài liệu:

- [ ] Tôi đã đọc TÓM TẮT (không chỉ relying vào AI summary)?

- [ ] Tôi đã đọc bài báo gốc cho ít nhất key papers?

- [ ] Tôi đã verify findings AI tổng hợp bằng đọc thật?

- [ ] Tôi có nhận thức về bias trong selection của AI?

4.3. Quy tắc "Stop and Think" - Dừng và Suy nghĩ

Trước khi nhấn "Submit" bất kỳ điều gì có liên quan đến AI, hãy dừng 30 giây và hỏi:

"Tôi có thực sự hiểu nội dung này không?"

"Tôi có thể bảo vệ mọi điểm trong này nếu được chất vấn không?"

"Có ai bị tổn hại nếu nội dung này sai không?"

"Tôi có khai báo việc dùng AI một cách trung thực không?"

Nếu trả lời "Không" cho bất kỳ câu nào → DỪNG LẠI và sửa.

💻 PHẦN 5: THỰC HÀNH - PHÁT HIỆN VÀ XỬ LÝ RỦI RO

5.1. Thực hành 1: Phát hiện Hallucination (15 phút)

Bài tập 1A: Yêu cầu AI tạo tài liệu tham khảo

Bước 1: Mở ChatGPT và đặt câu hỏi:

Hãy cho tôi 5 bài báo khoa học về "ứng dụng AI trong chẩn đoán

viêm phổi tại bệnh viện Việt Nam" xuất bản từ năm 2022 trở lại đây.

Yêu cầu mỗi bài có:

- Tên đầy đủ tác giả

- Năm xuất bản

- Tên bài báo

- Tạp chí

- DOI hoặc PMID

- Tóm tắt 2-3 câu

Bước 2: Lưu lại câu trả lời của AI.

Bước 3: Mở PubMed (https://pubmed.ncbi.nlm.nih.gov) và Google Scholar.

Bước 4: Tìm từng bài báo:

- Search bằng title chính xác

- Search bằng tác giả

- Verify DOI

Bước 5: Đếm:

- Bao nhiêu bài có thật?

- Bao nhiêu bài là giả (hallucination)?

- Bao nhiêu bài có thật một phần (tác giả đúng nhưng tựa đề sai, v.v.)?

Kết quả thường gặp: 60-100% bài báo từ ChatGPT là hallucination.

Bài tập 1B: Phát hiện thông tin sai

Bước 1: Hỏi ChatGPT:

Hãy cho tôi liều khởi đầu, liều tối đa, và các tác dụng phụ chính

của thuốc [tên một thuốc rất ít phổ biến hoặc thuốc mới] trong điều trị

[bệnh].

Bước 2: So sánh câu trả lời của AI với:

- Hướng dẫn của Bộ Y tế VN

- Tờ hướng dẫn sử dụng thuốc (chính hãng)

- UpToDate hoặc Medscape

Bước 3: Phát hiện:

- Có thông tin sai không?

- Mức độ nguy hiểm nếu áp dụng vào BN?

5.2. Thực hành 2: Phân tích Case Study Thực tế (15 phút)

Case Study 1: Vi phạm bảo mật

Bác sĩ Hoa, công tác tại khoa Nhi BV Trung ương, gặp một ca khó: bé trai 5 tuổi với triệu chứng phức tạp. Cô viết tóm tắt ca bệnh đầy đủ (bao gồm tên bé, mã bệnh án, các xét nghiệm cụ thể với ngày giờ) và paste vào ChatGPT để hỏi chẩn đoán phân biệt. ChatGPT cho câu trả lời rất hay. Bác sĩ Hoa rất hài lòng và quyết định "từ giờ sẽ luôn dùng cách này".

Câu hỏi thảo luận:

Bác sĩ Hoa đã vi phạm những gì?

Hậu quả pháp lý có thể là gì?

Cách làm đúng nên là như thế nào?

Case Study 2: Hallucination trong nghiên cứu

Nhóm nghiên cứu ở một trường đại học Việt Nam viết bài tổng quan về "Công nghệ blockchain trong y tế". Họ dùng ChatGPT để soạn bài. ChatGPT cung cấp 30 tài liệu tham khảo trông rất chuyên nghiệp. Nhóm submit bài đến tạp chí Q3. Reviewer phát hiện 18/30 tài liệu là giả. Bài báo bị reject ngay lập tức và nhóm bị đưa vào blacklist của nhà xuất bản.

Câu hỏi thảo luận:

Sai lầm chính của nhóm là gì?

Hậu quả lâu dài cho sự nghiệp của họ là gì?

Làm sao để tránh?

Case Study 3: Bias chủng tộc

AI Algorithm X được phát triển ở Mỹ để dự đoán nguy cơ ung thư da từ ảnh chụp. Nó được train chủ yếu trên ảnh người da trắng. Một bệnh viện ở Việt Nam mua quyền sử dụng và áp dụng cho bệnh nhân Việt. Sau 6 tháng, họ phát hiện AI bỏ sót 40% các ca melanoma ở bệnh nhân Việt (so với 5% ở Mỹ).

Câu hỏi thảo luận:

Vấn đề bias xuất hiện ở đâu?

Bệnh viện đáng lẽ phải làm gì trước khi triển khai?

Áp dụng nguyên tắc đạo đức nào ở đây?

5.3. Thực hành 3: Xây dựng Verification Workflow (10 phút)

Nhiệm vụ: Lấy một câu hỏi nghiên cứu hoặc lâm sàng của bạn. Hãy:

Hỏi ChatGPT về câu hỏi đó (5 phút)

Áp dụng quy trình 3 lớp kiểm tra (5 phút):

Lớp 1: Tìm 2 thông tin cụ thể trong câu trả lời và verify trên nguồn tin cậy

Lớp 2: Đánh giá tính áp dụng cho BN VN

Lớp 3: Có vấn đề đạo đức nào không?

Sản phẩm: Một bảng đánh giá ngắn cho thấy:

- Câu trả lời AI có chính xác không?

- Có thể áp dụng được không?

- Có an toàn về đạo đức không?

📊 PHẦN 6: TỔNG KẾT - MA TRẬN QUYẾT ĐỊNH

Đây là công cụ ra quyết định nhanh cho bạn:

6.1. Khi nào nên dùng AI?

| Tình huống | Có nên dùng? | Lý do |

|---|---|---|

| Brainstorming ý tưởng | ✅ CÓ | Rủi ro thấp, lợi ích cao |

| Tóm tắt bài báo (đã đọc) | ✅ CÓ | AI tóm tắt + bạn verify |

| Cải thiện tiếng Anh | ✅ CÓ | Rủi ro thấp nếu kiểm tra |

| Viết draft (rồi rewrite) | ✅ CÓ | Tăng tốc + giữ tư duy |

| Tính cỡ mẫu | ⚠️ CẨN THẬN | Phải verify với tool truyền thống |

| Phân tích thống kê | ⚠️ CẨN THẬN | Phải hiểu code, verify kết quả |

| Tạo tài liệu tham khảo | ❌ KHÔNG | 60-100% hallucination |

| Phân tích hồ sơ BN có định danh | ❌ KHÔNG | Vi phạm bảo mật |

| Quyết định lâm sàng cuối cùng | ❌ KHÔNG | Trách nhiệm con người |

| Viết toàn bộ bài báo | ❌ KHÔNG | Plagiarism + thiếu tư duy |

6.2. Quy tắc "GIẢI" để nhớ

Khi do dự về việc dùng AI, hãy nhớ GIẢI:

- Giải pháp: AI có phải giải pháp tốt cho vấn đề này không?

- Iẩn danh: Tôi đã ẩn danh dữ liệu chưa?

- Ải kiểm tra: Tôi sẽ verify kết quả như thế nào?

- Intelligence: Tôi vẫn dùng tư duy của mình chứ?

📋 PHẦN 7: CHECKLIST KIẾN THỨC SAU BÀI HỌC

Kiến thức cốt lõi:

- [ ] Liệt kê được 5 lợi ích chính của AI

- [ ] Hiểu và giải thích được 6 rủi ro chính

- [ ] Áp dụng được 4 nguyên tắc đạo đức y sinh học vào AI

- [ ] Mô tả được mô hình "3 lớp kiểm tra"

Kỹ năng thực hành:

- [ ] Có thể phát hiện hallucination trong câu trả lời AI

- [ ] Biết cách ẩn danh dữ liệu BN trước khi dùng AI

- [ ] Có thể verify tài liệu tham khảo từ AI

- [ ] Có quy trình kiểm tra cá nhân

Thái độ:

- [ ] Nhận thức về cả lợi ích và rủi ro của AI

- [ ] Cam kết dùng AI có trách nhiệm

- [ ] Sẵn sàng "stop and think" trước khi dùng AI

🎯 PHẦN 8: CÂU HỎI THẢO LUẬN NÂNG CAO

Câu hỏi triết lý:

Câu hỏi mở: Liệu một bài báo viết "phần lớn" bằng AI nhưng có khai báo trung thực có nên được công nhận giá trị khoa học?

Câu hỏi đạo đức: Nếu một nghiên cứu giúp ích cho cộng đồng nhưng có dùng AI vi phạm một số nguyên tắc nhỏ, có nên xuất bản?

Câu hỏi tương lai: Trong 10 năm tới, vai trò của con người trong nghiên cứu sẽ thay đổi như thế nào?

Câu hỏi tình huống:

Đồng nghiệp của bạn đang dùng AI không đúng cách (vi phạm bảo mật BN). Bạn sẽ làm gì?

Bạn nhận một bài báo để peer review, và phát hiện có dấu hiệu được viết hoàn toàn bằng AI (không khai báo). Trách nhiệm của bạn là gì?

Bệnh viện của bạn muốn mua một AI tool đắt tiền để dự đoán nguy cơ. Bạn sẽ đặt những câu hỏi gì trước khi đồng ý?

Câu hỏi ứng dụng:

Hãy thiết kế một "AI Use Policy" cho khoa của bạn. Bao gồm: được phép làm gì, không được làm gì, quy trình kiểm tra.

Nếu bạn là tổng biên tập một tạp chí y khoa Việt Nam, bạn sẽ ban hành quy định gì về việc dùng AI?

📚 TÀI LIỆU THAM KHẢO BÀI 2

Nguyên tắc đạo đức y sinh học:

Beauchamp, T. L., & Childress, J. F. (2019). Principles of Biomedical Ethics (8th ed.). Oxford University Press.

World Medical Association. (2024). Declaration of Helsinki - Ethical Principles for Medical Research Involving Human Subjects.

Hallucination trong AI:

Bender, E. M., et al. (2021). On the dangers of stochastic parrots: Can language models be too big? Proceedings of FAccT 2021.

Ji, Z., et al. (2023). Survey of hallucination in natural language generation. ACM Computing Surveys, 55(12).

Bias trong y tế AI:

Obermeyer, Z., et al. (2019). Dissecting racial bias in an algorithm used to manage the health of populations. Science, 366(6464), 447-453.

Vyas, D. A., et al. (2020). Hidden in plain sight - reconsidering the use of race correction in clinical algorithms. NEJM, 383(9), 874-882.

Quy định và hướng dẫn:

ICMJE. (2025). Recommendations on AI Use in Medical Publications.

WHO. (2024). Ethics and Governance of AI for Health.

COPE. (2024). Authorship and AI Tools.

Bảo mật dữ liệu y tế:

Bộ Y tế Việt Nam. (2023). Quy định về Bảo mật Thông tin Y tế.

EU GDPR. (2018). General Data Protection Regulation.

Bài đọc thêm cho người quan tâm:

O'Neil, C. (2016). Weapons of Math Destruction: How Big Data Increases Inequality and Threatens Democracy. Crown.

Topol, E. (2019). Deep Medicine. Basic Books.

✅ ĐÁP ÁN CÁC CHECKPOINT

Checkpoint 1:

Câu trả lời mở. Quan trọng là bạn đã suy nghĩ về lợi ích cụ thể với hoàn cảnh của mình.

Checkpoint 2:

Tình huống A: Có 3 rủi ro chính:

Hallucination (5 references có thể là giả)

Plagiarism (copy-paste nguyên văn)

Vi phạm ICMJE (không khai báo dùng AI)

Tình huống B: KHÔNG an toàn, ngay cả khi đã ẩn tên:

- Mã bệnh án vẫn có thể định danh

- Ngày khám + chuyên khoa có thể truy ra BN

- Vi phạm Luật Khám chữa bệnh

- Cách an toàn: Mô tả ca bệnh giả lập (de novo description) không từ hồ sơ thực

Tình huống C: KHÔNG nên tin ngay:

- Knowledge cutoff của AI có thể trước 2025

- AI có thể hallucinate guidelines mới

- Phải verify trên website chính thức (ESC, AHA, Bộ Y tế)

Checkpoint 3 (Phân tích case Bác sĩ Nam):

1. Vi phạm Beneficence:

- Phương pháp này có thể tạo ra "lợi ích giả" (kết quả không reliable do hallucination)

- Lan truyền cách làm sai cho đồng nghiệp → Không mang lại lợi ích thực

2. Vi phạm Non-maleficence:

- Có thể gây hại cho 500 BN nếu dữ liệu bị leak

- Có thể gây hại cho đồng nghiệp (làm theo và bị kỷ luật)

- Có thể gây hại cho khoa học (kết quả AI không verified)

3. Vi phạm Autonomy:

- BN không được informed consent về việc dữ liệu được dùng cho AI

- Đồng nghiệp được khuyến khích làm sai mà không biết rủi ro

4. Vấn đề Justice:

- BN tham gia "không tự nguyện" vào nghiên cứu AI

- Lợi ích (publication) thuộc về BS Nam, rủi ro thuộc về BN

- Không công bằng trong phân bổ benefit/risk

🎓 KẾT LUẬN BÀI 2

Chúc mừng bạn đã hoàn thành bài học khó nhưng quan trọng nhất! Hãy nhớ:

💡 Thông điệp 1: AI mang lại lợi ích lớn, nhưng cũng có rủi ro lớn. Hiểu cả hai mặt là chìa khóa để dùng AI hiệu quả.

💡 Thông điệp 2: Hallucination, bias, và vi phạm bảo mật là 3 rủi ro nguy hiểm nhất. Luôn cảnh giác.

💡 Thông điệp 3: 4 nguyên tắc đạo đức y sinh học (Beneficence, Non-maleficence, Autonomy, Justice) áp dụng cho AI cũng như cho mọi quyết định y khoa.

💡 Thông điệp 4: Quy trình 3 lớp kiểm tra + Quy tắc GIẢI là công cụ thực tế để dùng AI an toàn.

Soạn giả: Đoàn Thái Hòa

Phiên bản: 1.0 (2026)

Liên hệ: thaihoadoanbrvt@gmail.com

Phản hồi: Mọi góp ý xin gửi về email

- Đăng nhập để gửi ý kiến